L’Éternaute : Netflix utilise l’IA générative pour la première fois dans une production originale

Jeudi dernier, à l’occasion de la publication des résultats du deuxième trimestre 2025 deNetflix, Ted Sarandos, co-PDG de N...

L'IA générative, ou GenAI, occupe une place centrale dans l'écosystème de l'intelligence artificielle actuelle, se déployant rapidement dans de nombreux secteurs. En France, elle s'immisce dans le quotidien des citoyens, en particulier chez les jeunes, où sa pénétration atteint 76 % parmi les 18-34 ans, comme le révèle une étude récente menée par Havas Market. Ce phénomène s'accompagne d'une utilisation accrue dans divers domaines tels que la santé, les loisirs, et les voyages, témoignant de son potentiel à fournir des réponses personnalisées et contextuelles. Dans le domaine éducatif, le ministère de l'Éducation nationale a élaboré un cadre pour encadrer l'utilisation de la GenAI dans les écoles, soulignant son rôle d'assistance plutôt que de substitution dans le processus d'apprentissage. Les élèves sont désormais formés dès le primaire, avec une utilisation autorisée sous supervision à partir de la classe de quatrième, reflétant une volonté de préparer les générations futures à ces nouvelles technologies.

En parallèle, les entreprises françaises affichent un optimisme notable quant à l'adoption de l'IA générative, perçue comme un levier majeur de productivité. Une étude de Cognizant, en collaboration avec Oxford Economics, met en lumière un environnement favorable en France, où le cadre réglementaire est jugé propice par 40 % des dirigeants. Cependant, des défis subsistent, notamment la pénurie de compétences, poussant les entreprises à lancer des programmes de formation interne. Malgré ces obstacles, le potentiel de la GenAI comme moteur d'innovation est reconnu, avec des applications variées selon les secteurs, illustrant une adoption sectorielle diversifiée. Dans le domaine de l'aéronautique, Europrop International a opté pour la solution Paradigm de LightOn, intégrant ainsi l'IA générative dans ses opérations pour optimiser la gestion des connaissances tout en préservant la confidentialité des données stratégiques.

La dynamique d'adoption de l'IA générative s'accompagne de développements technologiques significatifs. Baidu, acteur majeur chinois, a lancé ERNIE 4.5 et ERNIE X1, deux modèles open source offrant des performances avancées en compréhension et raisonnement multimodal, à des coûts compétitifs. Leur intégration dans des outils comme Ernie Bot vise à démocratiser l'accès à ces technologies, tout en stimulant la compétitivité face aux modèles américains. Par ailleurs, Google a rendu son outil NotebookLM disponible en version multilingue, élargissant ainsi son accessibilité et ses capacités de synthèse et de gestion de contenu, particulièrement utiles dans le secteur éducatif. Ces avancées technologiques renforcent l'attractivité de l'IA générative, tout en posant la question de la gouvernance et de la gestion des données qui reste un défi majeur pour les entreprises cherchant à exploiter pleinement ces technologies.

Enfin, le projet Spinoza, conduit par Reporters sans frontières et l'Alliance de la presse d'information générale, souligne l'importance de développer des outils d'IA générative éthiques dédiés au journalisme. Cette initiative vise à enrichir le travail des journalistes avec des données fiables, tout en respectant la propriété intellectuelle des médias. Le rapport "SpinozIA" présente une série de recommandations pour encadrer l'utilisation de l'IA dans les rédactions, garantissant ainsi l'intégrité de l'information dans les systèmes d'IA utilisés en journalisme. Ce projet témoigne de la volonté de réinventer le journalisme à l'ère numérique, en intégrant l'IA de manière responsable et éthique, tout en réaffirmant le rôle central des rédactions dans la production de contenus de qualité. Ces démarches mettent en lumière les enjeux éthiques et stratégiques de l'IA générative, appelant à une réflexion continue sur son intégration dans nos sociétés.

L'IA générative est une sous-catégorie de l'intelligence artificielle qui utilise des algorithmes pour créer de nouvelles données semblables à celles sur lesquelles elle a été entraînée. Elle fonctionne principalement grâce aux modèles de langage de grande taille (LLM) et aux réseaux de neurones profonds, permettant la génération de texte, d'images, de musique et bien plus encore.

Depuis ses débuts, l'IA générative a évolué de simples modèles de génération de texte à des systèmes capables de créer des contenus visuels et sonores complexes. Cette technologie a connu une accélération majeure avec l'introduction de modèles comme GPT de OpenAI et DALL-E, augmentant sa précision et son applicabilité.

L'IA générative trouve des applications dans de nombreux secteurs : l'éducation, où elle aide à personnaliser l'apprentissage ; le commerce, où elle optimise les parcours d'achat ; et les médias, où elle enrichit la création de contenu. Elle est également utilisée pour la reconnaissance d'images et la création artistique.

Les principaux acteurs de l'IA générative incluent des entreprises comme OpenAI, Google, et Microsoft. En France, des startups comme Mistral AI et LightOn jouent un rôle clé, soutenues par des initiatives comme le projet SpinozIA pour un journalisme éthique.

Malgré ses avancées, l'IA générative fait face à des défis comme la gestion des hallucinations, la protection des données, et l'impact environnemental. Les chercheurs travaillent sur des solutions pour améliorer la fiabilité et l'efficacité énergétique des modèles.

Se former à l'IA générative nécessite une compréhension des concepts de machine learning et de deep learning. Des formations sont disponibles en ligne via des plateformes comme Coursera et Udacity, ainsi que des programmes universitaires spécialisés.

L'avenir de l'IA générative est prometteur avec des innovations prévues dans l'intégration des agents autonomes et l'amélioration des LLMs. Les entreprises continuent d'investir massivement, anticipant des gains significatifs en productivité et en innovation.

L'IA générative transforme les entreprises en optimisant les processus de création et en améliorant la personnalisation des services. Elle offre des opportunités de croissance dans des secteurs variés, de la santé à la finance, en passant par le marketing.

L'IA générative utilise des algorithmes avancés pour créer de nouvelles données similaires à celles sur lesquelles elle a été entraînée. Elle fonctionne principalement grâce à des modèles de langage de grande taille (LLM) et des réseaux de neurones profonds. Ces modèles sont capables de générer du texte, des images et même de la musique en apprenant à partir de vastes ensembles de données. L'IA générative s'appuie sur des techniques comme l'apprentissage supervisé et non supervisé pour affiner ses capacités créatives et analytiques.

L'IA générative est utilisée dans divers domaines, notamment l'éducation, où elle personnalise le parcours d'apprentissage des élèves, et le commerce, où elle optimise l'expérience client et le parcours d'achat. Dans les médias, elle enrichit la création de contenu en générant des articles, des images et des vidéos. D'autres applications incluent la conception de produits, la génération de musique et d'art, et la synthèse de voix pour des assistants virtuels.

L'IA générative a considérablement évolué avec l'introduction de modèles de langage avancés comme GPT et DALL-E. Ces innovations ont permis d'améliorer la précision et la diversité des contenus générés. Les progrès en matière de puissance de calcul et de disponibilité de données ont également joué un rôle crucial dans cette évolution. Les modèles actuels sont plus performants, capables de générer des contenus multimodaux et de s'adapter à divers contextes.

Les acteurs principaux de l'IA générative incluent des entreprises technologiques telles que OpenAI, Google, et Microsoft, qui développent des modèles de langage de pointe. En France, des startups comme Mistral AI et LightOn émergent avec des solutions innovantes. Des initiatives comme le projet SpinozIA, soutenu par Reporters sans frontières, visent à intégrer l'IA générative dans des domaines spécifiques comme le journalisme, en garantissant des pratiques éthiques.

Les tendances futures de l'IA générative incluent le développement d'agents autonomes capables de prendre des décisions complexes, l'amélioration de l'efficacité énergétique des modèles, et l'intégration de l'IA dans de nouveaux secteurs comme la santé et l'agriculture. Les perspectives incluent également une collaboration accrue entre les entreprises pour créer des solutions personnalisées et l'augmentation des investissements dans la recherche et le développement pour surmonter les défis actuels.

Pour se former à l'IA générative, il est essentiel de comprendre les principes fondamentaux du machine learning et du deep learning. Des plateformes comme Coursera, Udacity et edX offrent des cours en ligne sur ces sujets. Les universités proposent également des programmes spécialisés en intelligence artificielle. Il est recommandé de s'initier à des outils comme TensorFlow et PyTorch, qui sont largement utilisés dans le développement de modèles génératifs.

L'IA générative fait face à plusieurs défis techniques, notamment la gestion des hallucinations, où les modèles génèrent des informations incorrectes ou incohérentes. La protection des données et la confidentialité sont également des préoccupations majeures, tout comme l'impact environnemental lié à la consommation énergétique des modèles. Les chercheurs travaillent sur des solutions pour améliorer la fiabilité, l'efficacité et la transparence des systèmes d'IA générative.

L'IA générative transforme les entreprises en optimisant les processus de création et en améliorant la personnalisation des services. Elle permet de réduire les coûts, d'accélérer le développement de produits et d'améliorer l'expérience client. Dans des secteurs comme le marketing, l'éducation et la santé, l'IA générative offre des opportunités de croissance et d'innovation en automatisant des tâches complexes et en fournissant des insights basés sur les données.

255 articles liés à ce sujet

Jeudi dernier, à l’occasion de la publication des résultats du deuxième trimestre 2025 deNetflix, Ted Sarandos, co-PDG de N...

Nombre de lycéens comme de collégiens n'ont pas attendu le feu vert de leurs professeurs pour utiliser ChatGPT lors de leurs devoirs...S...

L'IA générative s'impose aujourd'hui comme un acteur clé du paysage numérique français. À partir d&rsqu...

NotebookLM, un outil de gestion documentaire basé sur l'intelligence artificielle Google annonce que NotebookLM, son outil intelligent de prise...

Malgré des résultats déjà tangibles, les entreprises françaises peinent à passer à l’éch...

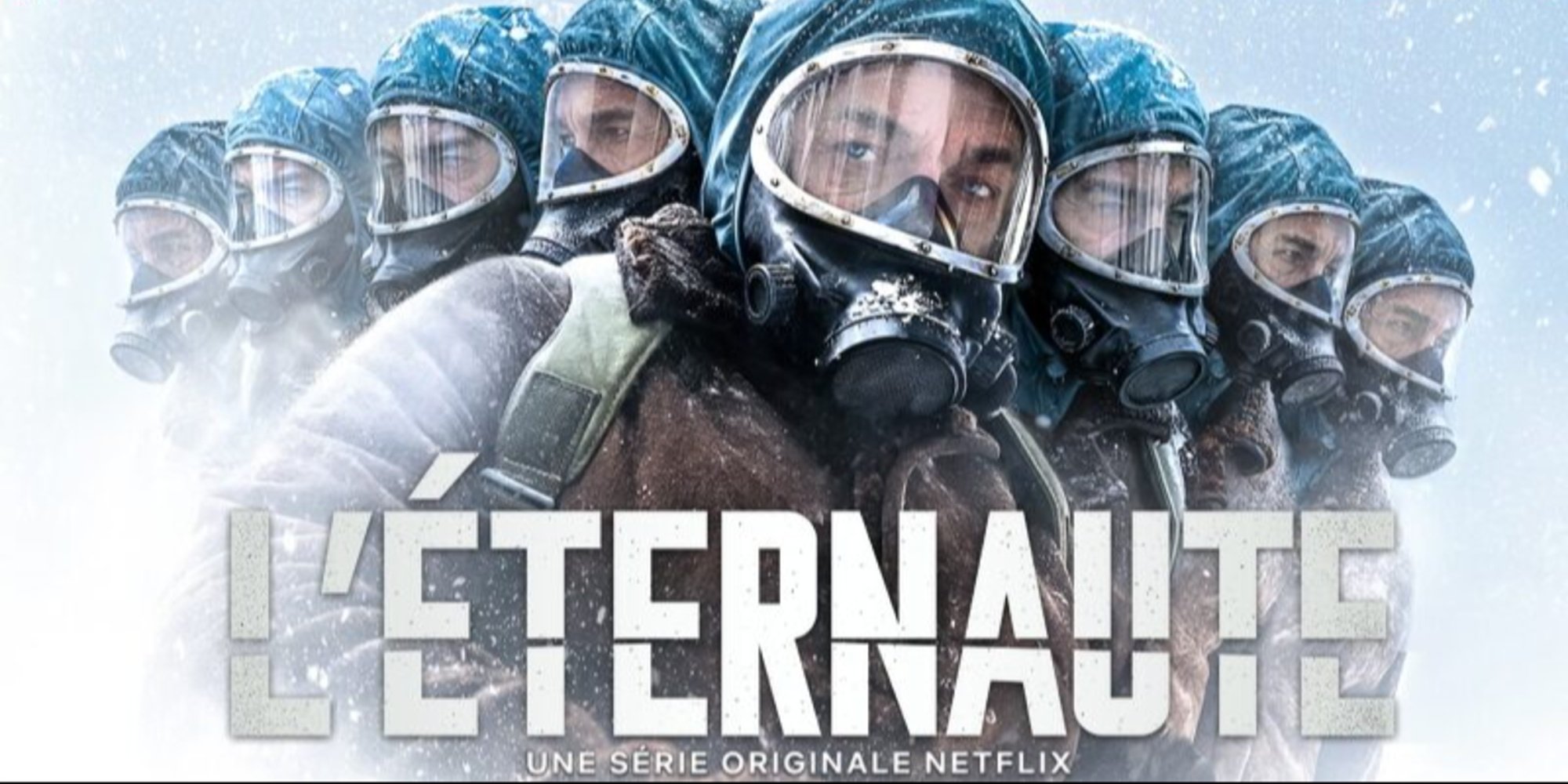

Malgré un engouement mondial pour la GenAI, une étude récente d’IDC, sponsorisée par Qlik, un leader des solutions d...

Avec le lancement de R1, DeepSeek a non seulement créé une onde de choc dans la Silicon Valley mais intensifié la concurrence au...

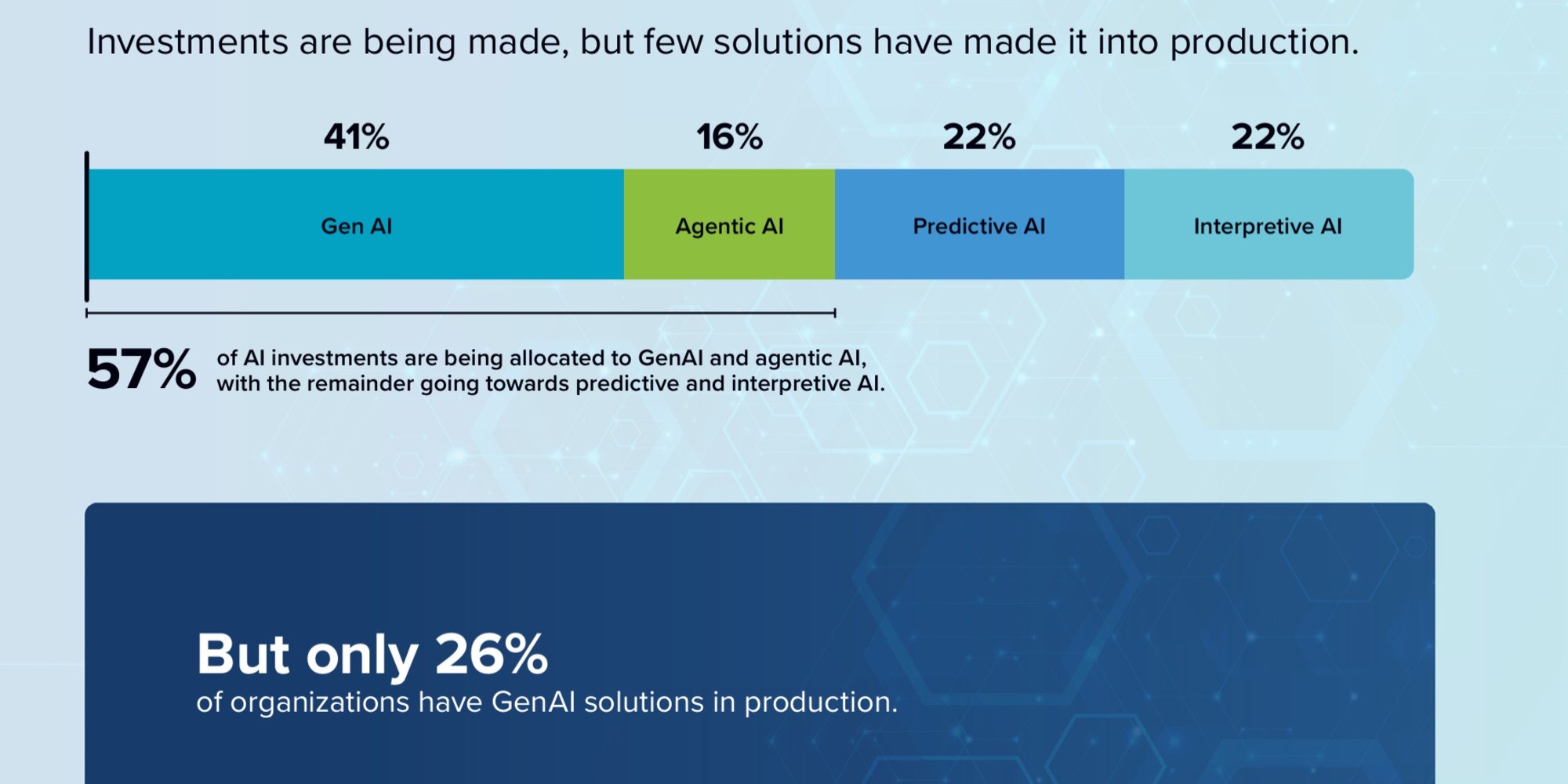

La conférence NVIDIA GTC, rendez-vous annuel majeur pour les professionnels de l'intelligence artificielle et du calcul accélér&e...

En novembre 2023, l’ONG Reporters sans frontières (RSF) et l’Alliance de la presse d’information générale (Apig) annonçaient collaborer dans le cadre...

Une étude récente de l'ESN Cognizant, réalisée en collaboration avec Oxford Economics auprès de 2 200 dirigeants de différents secteurs dans 23 pays,...

LightOn, acteur européen majeur dans le domaine de l’IA générative, et Europrop International GmbH (EPI), consortium regroupant quatre leaders europée...

Mistral AI, la licorne française, a annoncé mardi dernier de nouvelles fonctionnalités en version beta pour son assistant conversationnel gratuit "Le...