Publié sur arXiv ce 9 juillet, Talk the Walk: Navigating New York City through Grounded Dialogue est un projet de l'équipe de chercheurs du FAIR et de l'Université de Montréal, composée d'Harm de Vries, Kurt Shuster, Dhruv Batra, Devi Parikh, Jason Weston et Douwe Kiela. Disponible en open source, il s'agit d'une intelligence artificielle basée sur un réseau de neurones, capable de donner des instructions à un individu sans aucune aide pour le guider jusqu'à un lieu précis, à New York.

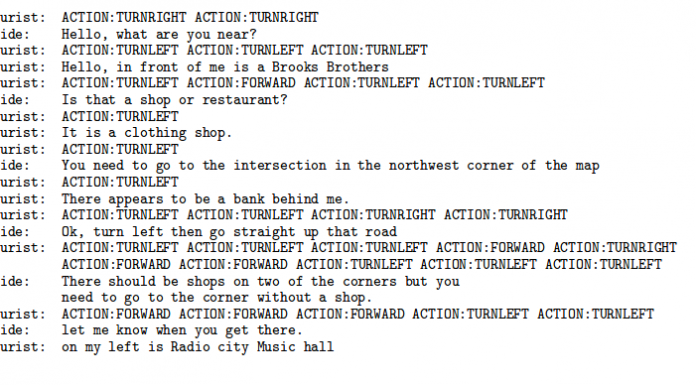

"Nous présentons « Talk The Walk », le premier ensemble de données de dialogue à grande échelle basé sur l'action et la perception. La tâche implique deux agents (un « guide » et un « touriste ») qui communiquent par le biais du langage naturel afin d'atteindre un objectif commun : faire en sorte que le touriste navigue vers un lieu cible donné.Il s'agit donc de premières recherches afin de travailler sur une nouvelle fonctionnalité dans l'un des domaines majeurs liés à l'intelligence artificielle : le traitement automatique du langage naturel. Les chercheurs ont mis à disposition en open source un ensemble de données ainsi que des algorithmes de base afin de montrer que le concept de base fonctionne et leur propre approche du problème (cf. également la vidéo ci-dessus).La tâche et l'ensemble de données, qui décrits en détail [dans la publication], constituent un véritable défi et la solution complète est un problème ouvert que nous posons à la communauté. Nous nous concentrons sur la localisation touristique et développons le nouveau mécanisme MASC (Masked Attention for Spatial Convolutions) qui permet d'ancrer les énoncés touristiques dans la carte du guide, il montre qu'il apporte des améliorations significatives pour la communication en langage naturel et émergent, et, en utilisant cette méthode, nous établissons des lignes de base non triviales sur la tâche complète."

L'ensemble de données contient des cartes de New York, des images 360° d'endroits de la carte prises avec des capteurs, un échantillon de traitement automatique du langage naturel (NLP) composé de près de 10.000 conversations entre des personnes se guidant vers des endroits précis.

Plus concrètement, le réseau de neurones, qui devra nécessairement être étoffé, doit pouvoir fournir des directions à la personne (le touriste de l'exemple) sans avoir recours ni à un GPS ni à un autre système de localisation. Il suffirait d'une communication avec l'IA, comme s'il s'agissait d'un guide ou d'un office de tourisme pour pouvoir orienter l'individu. Ce dernier n'aurait donc qu'à décrire ce qu'il voit, des points de repère comme la forme d'un bâtiment, le nom d'un magasin à proximité, un lieu connu, afin que le système puisse déterminer leur situation. L'intelligence artificielle devrait également être en mesure d'interroger son interlocuteur pour affiner la recherche, pouvoir déterminer avec précision son emplacement et construire une réponse en langage clair pour le guider jusqu'au lieu souhaité.

Retrouvez l'article des chercheurs sur arXiv.