LinkedIn a annoncé récemment avoir rendu open source TonY, son projet permettant aux chercheurs et développeurs d’exécuter facilement des jobs TensorFlow sur Hadoop, Map/Reduce et Spark.

LinkedIn propose désormais en open source TonY. Ce projet permet d'aider à ses utilisateurs de jouer des scénarios TensorFlow sur les environnements Hadoop, nativement, mais également sur Spark et Map/Reduce. Jonathan Hung, senior software engineer dans l'équipe de développement Hadoop chez LinkedIn, a expliqué dans un post de blog :

"Nous voulions un moyen flexible et durable de combler le fossé entre la puissance analytique distribuée de TensorFlow et la puissance de gradualité (scaling) de Hadoop. [...]

De façon similaire à la manière dont MapReduce fournit le moteur d'exécution des scripts Pig / Hive sur Hadoop, et que Spark fournit le moteur d'exécution du code Scala utilisant les API Spark, TonY vise à fournir le même support de première classe pour l'exécution des tâches TensorFlow, en gérant des tâches comme la négociation de ressource et la configuration d'environnement de containers."

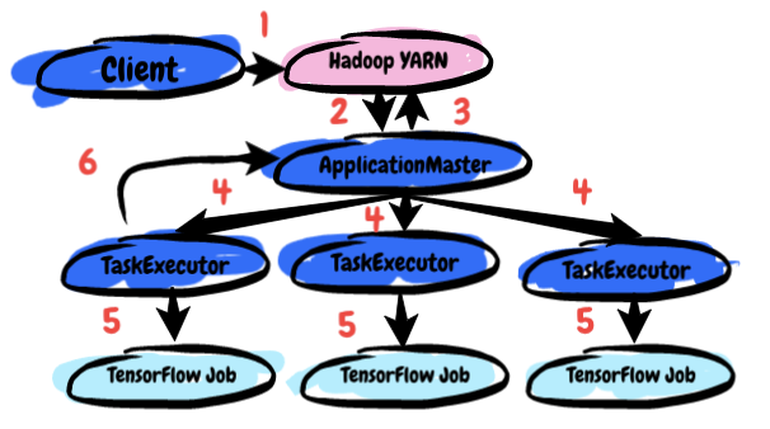

"Il existe trois composants principaux pour TonY: Client, ApplicationMaster et TaskExecutor. C'est le processus complet pour exécuter un travail TonY:

- L'utilisateur soumet le code de formation du modèle TensorFlow, les arguments de soumission et leur environnement virtuel Python (contenant la dépendance TensorFlow) au Client.

- Le Client configure l'ApplicationMaster (AM) et le soumet au cluster YARN.

- AM négocie les ressources avec le gestionnaire de ressources de YARN en fonction des besoins en ressources de l’utilisateur (nombre de serveurs de paramètres et de travailleurs, mémoire et GPU).

- Une fois que AM reçoit des allocations, il génère des TaskExecutors sur les nœuds alloués.

- TaskExecutors lance le code de formation de l'utilisateur et attend son achèvement.

- Le code de formation de l’utilisateur démarre et TonY effectue périodiquement des pulsations entre TaskExecutors et AM pour vérifier la qualité de vie."