Décoder les stimuli visuels des enregistrements cérébraux peut apporter une meilleure compréhension du système visuel humain, améliorant ainsi la connaissance du cerveau et du processus cognitif. Des chercheurs de l'Université nationale de Singapour et de l'Université chinoise de Hong Kong ont développé MinD-Video, une IA capable de créer des vidéos de haute qualité à partir de l'activité cérébrale enregistrée grâce à l'imagerie par résonance magnétique fonctionnelle (IRMf) et un modèle Stable Diffusion augmenté.

L'idée d'utiliser l'IRMf pour décoder et reconstruire des vidéos n'est pas nouvelle : en 2011, des chercheurs du laboratoire Jack Gallant de l’Université de Berkeley, en Californie, dont Shinji Nishimoto, chercheur postdoctoral au laboratoire, l'ont associée à la simulation informatique pour reconstruire, plus ou moins approximativement, des bandes-annonces de films hollywoodiens visionnées par les chercheurs.

Depuis, les progrès dans le domaine du deep learning ont permis de développer des IA génératives permettant d'explorer de nouvelles approches.

Ainsi, Shinji Nishimoto, aujourd'hui professeur à l’Université d’Osaka au Japon et l'un de ses collègues, Yu Takagi, ont utilisé Stable Diffusion, le générateur de texte en image publié par Stability AI en août 2022, pour transformer les activités cérébrales mesurées par IRMf en images fixes.

Reconstruire la vision à partir de données IRMf

Notre vision est un flux continu et diversifié de scènes, de mouvements et d’objets, la reconstruire à partir de données IRMf est une tâche beaucoup plus complexe que la reconstruction d'images fixes.Bien que l’IRMf puisse cartographier l’activité cérébrale à un endroit spécifique avec une résolution élevée, le signal sanguin, dépendant du niveau d’oxygène (BOLD) qu’elle mesure, est notoirement lent : une impulsion d’activité neuronale provoque une augmentation et une baisse de BOLD sur environ 10 s. Chaque balayage IRMf représente une moyenne de l'activité cérébrale pendant l'instantané.

En revanche, une vidéo typique compte environ 30 images par seconde (FPS). Si un balayage IRMf prend 2 secondes, pendant ce temps, 60 images vidéo, contenant potentiellement divers objets, mouvements et changements de scène, seront présentées comme stimuli visuels. Ainsi, décoder l'IRMf et récupérer des vidéos à un FPS beaucoup plus élevé que la résolution temporelle de l'IRMf est une tâche très complexe.

Mind-Vidéo : reconstruction vidéo de haute qualité à partir de l’activité cérébrale

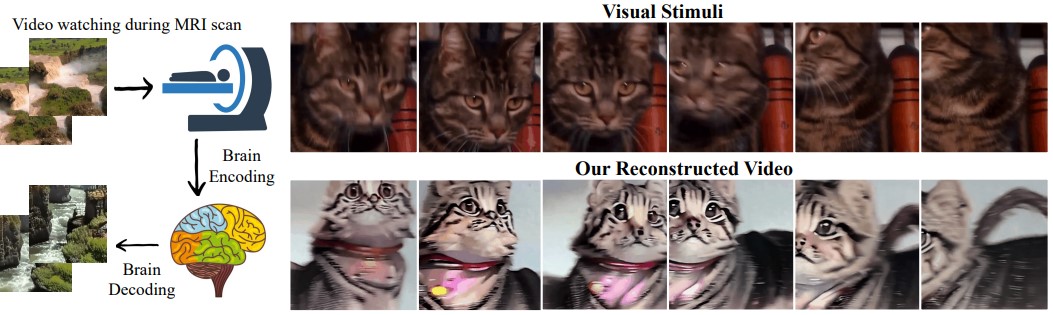

Jiaxin Qing, chercheur de l'Université Chinoise de Hong Kong ainsi que Zijiao Chen et Juan Helen Zhou de l'Université Nationale de Singapour ont décidé de s'y attaquer : ils proposent une approche d’apprentissage progressif pour récupérer l’expérience visuelle continue à partir de l'IRMf, ce qui leur a permis de reconstruire des vidéos de haute qualité avec des sémantiques et des mouvements précis.[caption id="attachment_44420" align="aligncenter" width="1053"] Décodage cérébral et reconstruction vidéo. Les chercheurs proposent une approche d'apprentissage progressif pour récupérer l'expérience visuelle continue à partir de la fMRI. Des vidéos de haute qualité avec des sémantiques et des mouvements précis sont reconstruites.[/caption]

Décodage cérébral et reconstruction vidéo. Les chercheurs proposent une approche d'apprentissage progressif pour récupérer l'expérience visuelle continue à partir de la fMRI. Des vidéos de haute qualité avec des sémantiques et des mouvements précis sont reconstruites.[/caption]

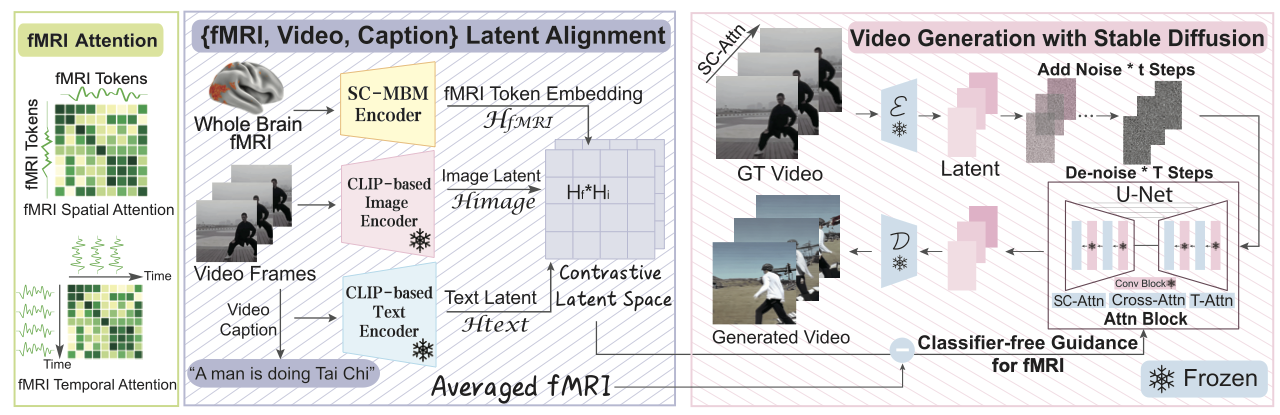

Ils ont développé MinD-Video, un pipeline en deux modules conçu pour combler le fossé entre le décodage d'images et de vidéos cérébrales qu'ils présentent comme une extension de précédents travaux de reconstruction d’images IRMf : MinD-Vis (CVPR2023).

[caption id="attachment_44421" align="aligncenter" width="1280"] Les deux modules sont entraînés séparément, puis affinés ensemble.[/caption]

Les deux modules sont entraînés séparément, puis affinés ensemble.[/caption]

Dans le 1er module, le modèle parti de l'apprentissage non supervisé à grande échelle avec la modélisation cérébrale masquée pour apprendre les caractéristiques visuelles générales de la fMRI. Les chercheurs utilisent ensuite la multimodalité du jeu de données annoté pour entraîner l'encodeur fMRI dans l'espace de pré- formation contrastif Langage-Image (CLIP) avec un apprentissage contrastif.

Dans le second module, les caractéristiques apprises sont affinées grâce au co-entraînement avec un modèle de diffusion stable augmenté, spécialement adapté à la génération de vidéos sous la direction de la fMRI.

Les chercheurs ont comparé leurs résultats avec ceux de différentes recherches consacrées à la reconstruction IRMf-Vidéo : selon eux, leur méthode génère des échantillons qui sont sémantiquement plus significatifs et correspondent à la vérité terrain.

Les vidéos reconstruites sont pour eux de haute qualité avec des sémantiques précises, par exemple des mouvements et des dynamiques de scène. Ils ont évalué leurs résultats avec des métriques sémantiques et de pixels aux niveaux vidéo et image : une précision de 85 % est atteinte dans les métriques sémantiques et 0,19 dans SSIM, dépassant les approches précédentes de pointe de 45 %.

Pour l'équipe :

"Notre méthode est encore au niveau intra-sujet, et la capacité de généralisation inter-sujet reste inexplorée en raison des variations individuelles. De plus, notre méthode n'utilise que moins de 10 % des voxels du cortex pour les reconstructions, tandis que l'utilisation des données du cerveau entier reste inexploitée".

Les chercheurs concluent :"Nous croyons que ce domaine a des applications prometteuses à mesure que les grands modèles se développent, de la neuroscience aux interfaces cerveau-ordinateur. Mais des réglementations gouvernementales et des efforts de la part des communautés de recherche sont nécessaires pour garantir la confidentialité des données biologiques d'une personne et éviter toute utilisation malveillante de cette technologie".

Référence de l'article : High-quality Video Reconstruction from Brain Activity

Auteurs : Jiaxin Qing, Université Chinoise de Hong Kong

Zijiao Chen et Juan Helen Zhou, Université Nationale de Singapour