La faune sous-marine calédonienne est très variée, mais ce sont ses grands représentants qui ont retenu l'attention de Laura Manocci. Pour mieux protéger ces animaux parfois rares comme le dugong ainsi que différents requins, des raies ou des tortues, la biologiste de Marbec et ses confrères ont imaginé un recensement aérien... en ULM ! Les chercheurs des laboratoires Entropie, du Limm et de Marbec ont collaboré à cette méthode innovante intégrant l'intelligence artificielle et plus précisément le Deep Learning.

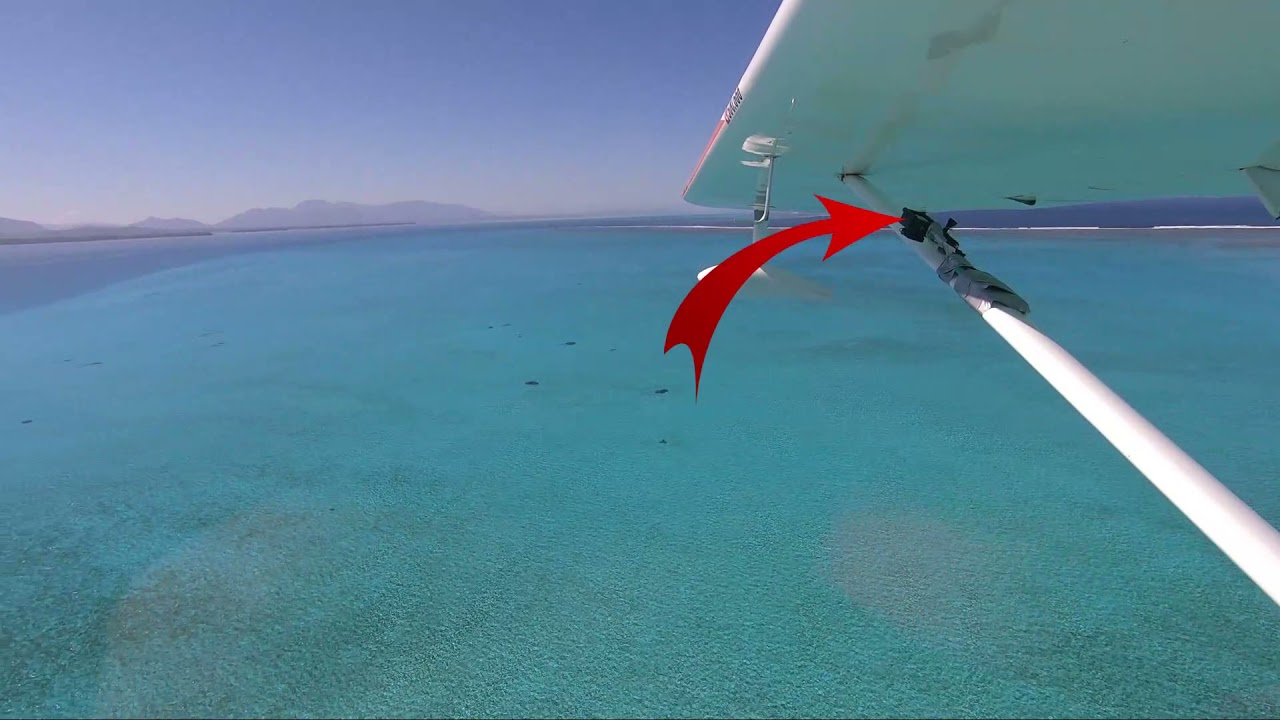

Jusqu'à présent, lorsqu'on voulait recenser la faune sous-marine on plongeait et on ramenait des vidéos. Laura Manocci a quant à elle préféré la voie des airs et c'est à bord de son ULM qu'elle a survolé et filmé le lagon calédonien, à une hauteur variant de 50 à 60 mètres. Elle a expliqué :

"Ces eaux sont très peu profondes, 2 mètres maximum, on peut donc voir les animaux marins même à cette altitude."Le problème a été ensuite d'identifier les différents animaux qui évoluaient sur ces images. Certains sont très rapides, d'autres rares comme le dugong puisqu'on n'en recense pas plus d'un millier dans les eaux calédoniennes. Les chercheurs ont donc fait appel à l'intelligence artificielle :

"Nous avons eu recours à ce qu’on appelle l’apprentissage profond ou Deep Learning, l’intelligence artificielle appliquée à la reconnaissance de forme."Mais pour appliquer l'apprentissage profond à ce genre d'algorithme, il faut être en mesure de lui apporter une grande quantité d'images. Les chercheurs sont allés les chercher là où il y en a pléthore et de surcroît gratuites : les réseaux sociaux. Laura Manocci a expliqué :

"Le dugong est un animal tellement emblématique qu’on s’est dit que lorsque les gens avaient la chance de le filmer, ils postaient probablement les images sur les réseaux sociaux."Pour le dugong, ils ont trouvé 20 vidéos qu'ils ont utilisées pour former un modèle d'apprentissage profond, ce programme est capable de détecter et identifier 80 % des animaux sur les vidéos.

"Cette méthode offre ainsi un nouveau moyen performant pour compter et cartographier les dugongs ainsi que d’autres espèces marines charismatiques dans le but de mieux les protéger. Ces recensements pourront notamment amener à émettre des recommandations pour placer en réserve stricte certaines zones si nécessaire."Réaliser de tels algorithmes reste un défi, explique encore Laura Manocci :

"Construire des bases de données de formation est encore plus difficile pour la mégafaune marine rare et menacée car la plupart des individus sauvages restent dans des endroits particuliers et souvent éloignés."Ils utilisent une architecture de réseaux de neurones convolutifs. Ces CNN sont des algorithmes d'apprentissage profond largement utilisés pour la classification d'images et la détection d'objets (localiser et classer simultanément des objets dans des images). Ils sont souvent utilisés pour détecter des animaux sur des images, les identifier et les classer, comme cela a été le cas pour recenser le dugong et les autres espèces du lagon calédonien.

FIGURE 1

Étapes de la méthode d'apprentissage en profondeur qui détecte la mégafaune rare (CNN, réseau de neurones convolutifs ; TP, vrai positif ; FP, faux positif ; FN, faux négatif). Les images de réseaux sox (gris) sont utilisées aux étapes 2 et 3. Les images de champ (noir) sont utilisées aux étapes 2, 4 et 5.

- À l'étape 1, des vidéos de médias sociaux des espèces d'intérêt sont collectées en recherchant des sites Web de médias sociaux avec des mots-clés appropriés. En parallèle, et de manière indépendante, des enquêtes vidéo de terrain sont menées dans la région d'étude.

- À l'étape 2, les images des vidéos de médias sociaux sont extraites et annotées (des cadres de délimitation sont dessinés manuellement autour de l'espèce d'intérêt). Les images annotées sont ensuite partitionnées en ensembles d'apprentissage et de test indépendants, et l'ensemble d'apprentissage est augmenté artificiellement. Les images des relevés vidéo de terrain sont également extraites et annotées.

- À l'étape 3, un CNN de détection d'objets préformé et accessible au public est téléchargé et recyclé pour la détection d'espèces sur l'ensemble de données des médias sociaux.

- À l'étape 4, un CNN est appliqué pour prédire les détections d'espèces sur les images d'enquête sur le terrain.

- À l'étape 5, les détections prédites sont comparées aux cadres de délimitation annotés manuellement sur les images de terrain et la précision du CNN est évaluée. Les mesures de performance sont calculées en fonction du nombre de vrais positifs (TP), de faux positifs (FP) et de faux négatifs (FN). Un TP correspond à un chevauchement entre une case prédite et une case annotée. Un cadre englobant prédit ne correspondant pas à un cadre englobant annoté est un FP, alors qu'un cadre englobant annoté ne correspondant pas à un cadre englobant prédit est un FN. La précision est le pourcentage de TP par rapport aux prédictions (équation 1). Il représente le pourcentage de prédictions correctes (le plus proche de 1, le moins de FP).