Des chercheurs du LabSix du MIT ont publié la V2 de leur étude "Synthesizing Robust Adversarial Examples". Anish Athalye, Logan Engstrom, Andrew Ilyas et Kevin Kwok ont ainsi mis en avant les problèmes d'identification d'objets dans le monde réel par les programmes de reconnaissance visuelle actuels.

Des "exemples contradictoires"

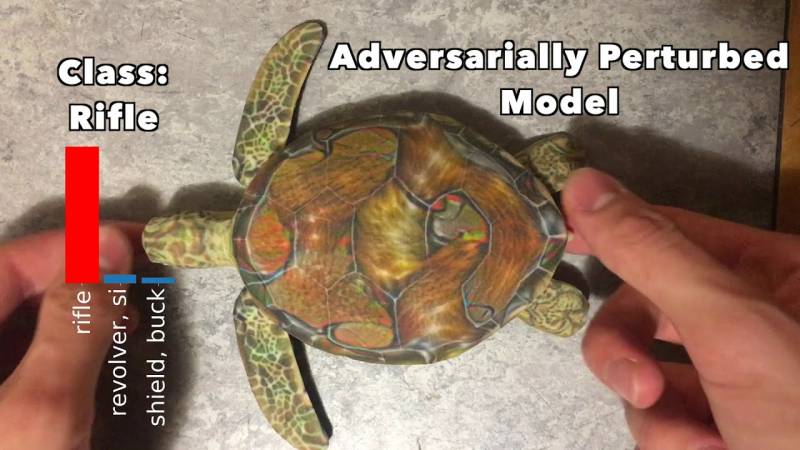

Ce groupe de recherche en intelligence artificielle est parvenu à piéger InceptionV3, l'IA de reconnaissance d'images de Google. Au cours de leur expérience, ils ont démontré comment le programme confondait une tortue imprimée en 3D avec un fusil, une balle de baseball avec un expresso ou encore un chat avec du guacamole. Ces objets ou images manipulés ont été baptisés par les chercheurs "exemples contradictoires"."Notre travail démontre que les exemples contradictoires sont un problème beaucoup plus important dans les systèmes du monde réel qu'on ne le pensait auparavant".La vidéo ci-dessus, tirée de leur expérience, montre comme l'IA de Google reconnait dans un premier temps la tortue et la qualifie correctement comme étant une tortue. Cependant, quand les chercheurs modifient la texture de la carapace 3D très légèrement, le programme l'identifie comme étant un fusil. L'objet manipulé est mal classé par l'IA, même lorsque le chercheur montre ses différentes faces.

Un programme créé pour exposer les faiblesses des programmes IA de reconnaissance visuelle

Cette étude est particulièrement intéressante car elle met en évidence les problématiques de l'identification des objets dans le monde réel et la non-fiabilité des programmes actuels. La reconnaissance visuelle est amenée à être présente dans de nombreux secteurs où la sécurité est fondamentale. Dans le cas des véhicules autonomes, les caméras devront pouvoir identifier les personnes et objets en mouvement en temps réel. Une erreur peut entraîner des conséquences dramatiques.L'étude du LabSix du MIT montre donc qu'à l'heure actuelle ce type de programmes IA peut mal classer un objet s'il est légèrement déformé, que cela soit dû à une manipulation intentionnelle ou non. Pour parvenir à ce résultat, l'équipe de chercheurs a conçu un programme visant à créer des images "contradictoires". Il permet de simuler des situations de la vie réelle avec des objets flous ou en mouvement que l'IA devrait pouvoir analyser et identifier.

Les technologies d'intelligence artificielle se multiplient et tendent à gagner en performance et en fiabilité. Mais il est important de pouvoir également en connaître les limites actuelles.