Stability AI, start-up basée à Londres, a annoncé le 22 août dernier la sortie publique de Stable Diffusion, un modèle text-to-image similaire à Dall-E 2 d'Open AI ou Imagen de Google. Ce modèle open-source est le fruit d’une collaboration entre Stability AI, RunwayML, des groupes de recherche du centre Machine Vision & Learning au LMU de Munich (anciennement laboratoire CompVis à l'Université de Heidelberg), d'EleutherAI et de LAION.

Avant cette sortie publique, Stability AI avait annoncé, le 10 août, la mise à disposition de Stable Diffusion, pour un millier de chercheurs, le modèle à grande échelle ayant été testé auparavant par plus de 10 000 bêta-testeurs via le serveur Discord.

Testez le modèle gratuitement sur Dream Studio.

Le système Stable Diffusion

Le modèle lui-même s'appuie sur les travaux de l'équipe de CompVis et Runway pour leur modèle de diffusion latent, qui a été combiné aux informations des modèles de diffusion conditionnelle de Katherine Crowson, développeur principal d'IA générative chez Stability AI, de Dall-E 2 d'Open AI, d'Imagen de Google Brain et d'autres modèles.L'ensemble de données de base a été formé sur LAION-Aesthetics, un sous-ensemble de LAION 5B, créé avec un nouveau modèle basé sur CLIP qui a filtré LAION-5B en fonction de la « beauté » d'une image, en s'appuyant sur les notes des testeurs alpha de Stable Diffusion. Le modèle a été entraîné sur un ultracluster d'IA composé de 4000 GPU A100 au cours du mois de juin dernier et sera le premier d'une série de modèles explorant cette approche et d'autres.

Stable Diffusion peut générer des images de 512×512 pixels, en quelques secondes, en utilisant environ 6,9 Go de VRAM sur les GPU grand public.

Stability AI a coopéré avec les équipes juridiques, éthiques et technologiques de HuggingFace pour publier le modèle sous une licence Creative ML OpenRAIL-M, une licence permissive, axée sur une utilisation éthique et morale, autorisant une utilisation commerciale et non commerciale.

En s'inscrivant à l'interface DreamStudio, les utilisateurs obtiennent gratuitement 200 crédits. Ensuite, ils paieront environ 1 euro pour 100 générations.

LAION-Aesthetics, sous-ensemble de LAION 5B

LAION, (Large-scale Artificial Intelligence Open Network), est une organisation à but non-lucrative qui se donne pour mission de mettre les modèles d'apprentissage automatique, les bases de données et le code à la disposition du public. Elle a conçu LAION 5B, un ensemble de données de 5,85 milliards de paires image-texte filtrées basé sur CLIP, 14 fois plus grand que LAION-400M, auparavant le plus grand ensemble de données image-texte ouvertement accessible au monde.Ensuite, elle a créé LAION-Aesthetics qui réunit plusieurs sous-ensembles de LAION 5B et a servi à la formation de Stable Diffusion.

Un modèle extrêmement prometteur

Les résultats sont extrêmement prometteurs et ce modèle open source démocratise encore la génération d'images pour une grande variété d'usages. La clause de non-responsabilité sur l’objectif de l’ensemble de données de LAION 5B rappelle que les données proviennent d'Internet et que l'ensemble n’est pas organisé, l'organisation conseille d'utiliser les liens de démonstration avec prudence et ne peut exclure entièrement la possibilité que du contenu nuisible soit toujours présent.LAION-400M, son prédécesseur, était connu pour contenir des textes et des images à connotation pornographique ou raciste. Stability AI a donc développé Safety Classifier, un classificateur de sécurité inclus par défaut dans le progiciel global Stable Diffusion, pour détecter et bloquer les images offensantes ou indésirables, qui peut être désactivé.

Le modèle a été divulgué sur Internet avant sa sortie publique, il a été utilisé par des internautes et notamment dans le forum de discussion 4chan pour générer des images de personnalités nues ou des scènes pornographiques.

DALL-E 2 comporte un filtre, qui l’empêche de générer des images de personnalités publiques, ce qui n'est pas le cas de Stability Diffusion, qui pourrait bien être utilisé pour créer des deepfakes.

Tests

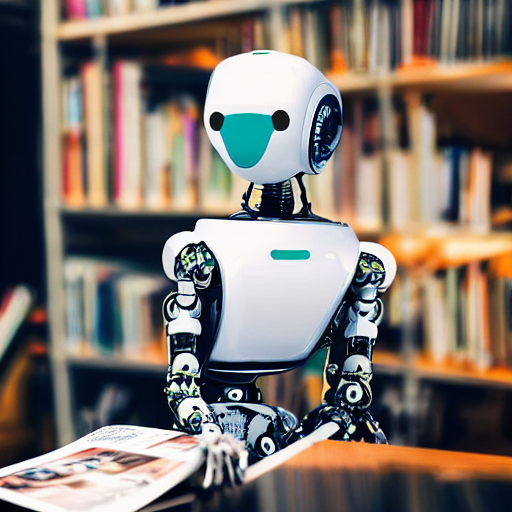

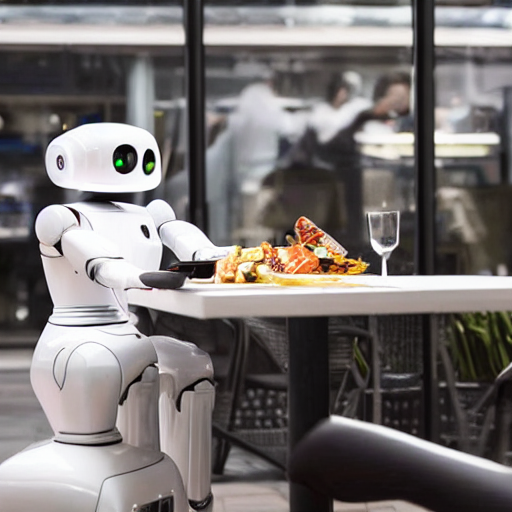

"A robot reading a magazine about Artificial Intelligence""A robot eating in a restaurant"

"A robot dog skiing in the alps"

(ces tests ont été réalisés le 1er septembre)

Testez Stability AI gratuitement sur Dream Studio