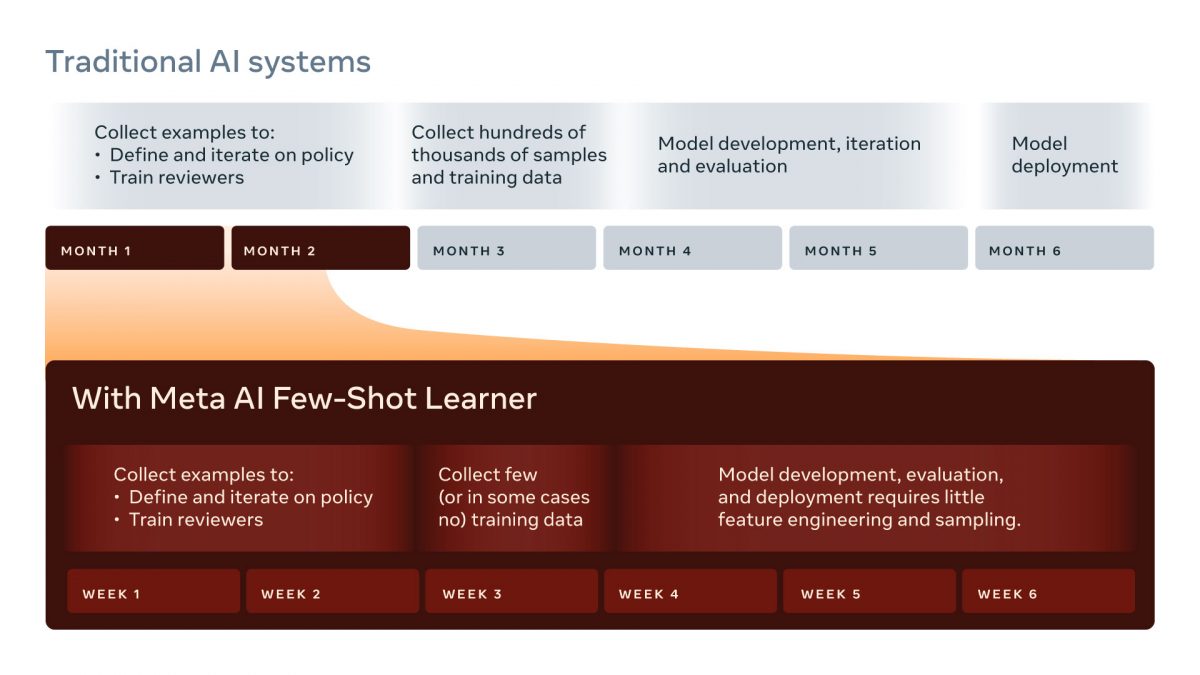

Les contenus préjudiciables évoluent très vite, les systèmes d'IA doivent donc suivre cette évolution en parallèle. Pour cela, l’IA doit apprendre ce qu'elle recherche, il faut plusieurs mois pour collecter et étiqueter les milliers, voire les millions, d'exemples nécessaires pour entraîner chaque système d'IA à repérer un nouveau type de contenu. Pour y remédier, Meta AI a construit et déployé une nouvelle technologie d'IA baptisée Few-Shot Learner (FSL) qui est capable de s’adapter en quelques semaines et de prendre des mesures sur de nouveaux contenus nuisibles.

Ce système d'IA présenté par Meta AI fonctionne dans plus de 100 langues et apprend également à partir de différents types de données, comme les images et le texte, et peut renforcer les modèles d'IA existants déjà déployés pour détecter d'autres types de contenus préjudiciables. Il utilise une méthode relativement nouvelle, appelée Few-Shot Learner (ou « apprentissage par petits coups »), dans laquelle les modèles commencent par une compréhension générale de nombreux sujets différents, puis utilisent beaucoup moins d'exemples étiquetés, et dans certains cas aucun, pour apprendre de nouvelles tâches. Si les systèmes traditionnels sont analogues à une ligne de pêche capable d'attraper un type spécifique de poisson, le FSL est un filet supplémentaire capable d'attraper également d'autres types de poissons.

[caption id="attachment_34401" align="aligncenter" width="696"] Meta AI[/caption]

Meta AI[/caption]

Un système qui dépasserait ceux de l’IA traditionnelle

Les techniques d'apprentissage auto-supervisé ainsi que la nouvelle infrastructure développées par Meta AI permettent d’aller plus loin que les systèmes d'IA traditionnels et de se tourner vers des systèmes plus grands, plus consolidés et généralisés, moins dépendants des données étiquetées. Contrairement aux systèmes précédents qui reposaient sur la correspondance de modèles avec des données étiquetées, le système FSL est d'abord entraîné sur des milliards d'exemples de langues génériques et libres, puis avec des contenus illicites étiquetés au fil des ans. Enfin, il est entraîné sur un texte condensé expliquant une nouvelle politique, de sorte qu'il peut apprendre le texte de la politique de manière implicite.Le FSL a été testé sur des événements nouveaux comme par exemple, l’identification de contenu qui partage des informations trompeuses ou sensationnelles susceptibles de décourager les vaccinations COVID-19 (par exemple, « Vaccin ou modificateur d'ADN ? »). Dans une autre tâche distincte, le nouveau système d'IA a amélioré un classificateur existant qui signale les contenus proches de l'incitation à la violence (par exemple, « Ce type a-t-il besoin de toutes ses dents ? »). L'approche traditionnelle aurait pu passer à côté de ces types de messages car il n'y a pas beaucoup d'exemples étiquetés qui utilisent le langage de l'ADN pour créer une hésitation sur le vaccin ou qui font référence aux dents pour impliquer la violence.

[caption id="attachment_34407" align="aligncenter" width="696"] Meta AI[/caption]

Meta AI[/caption]

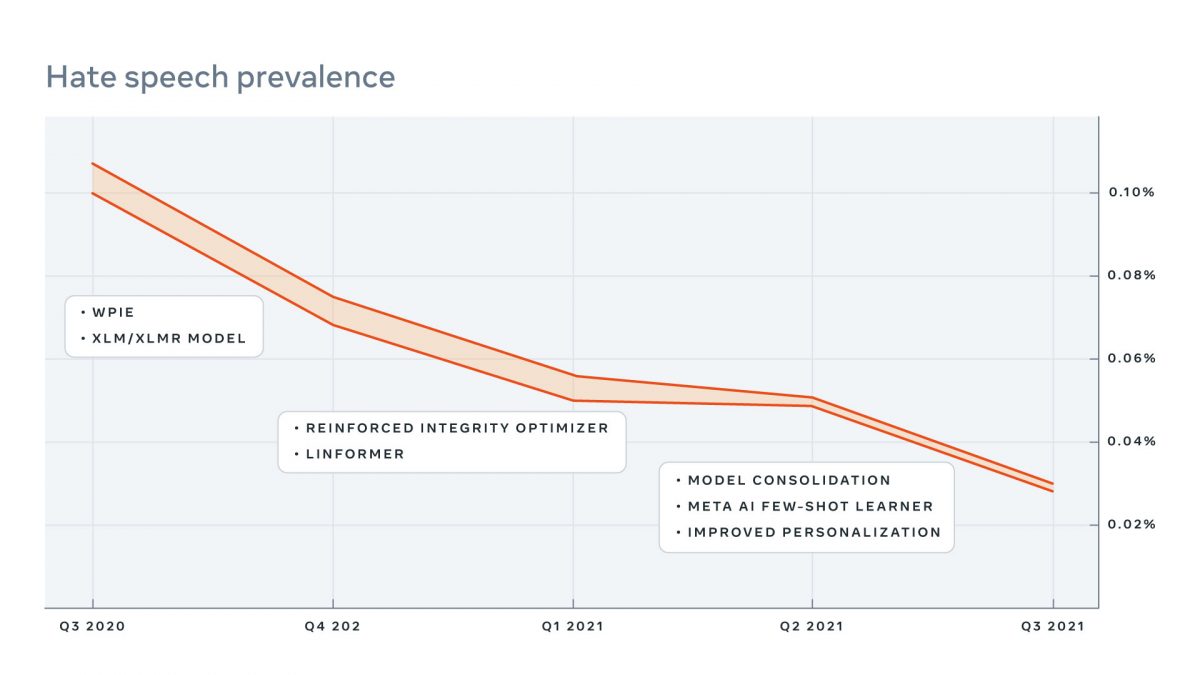

Meta AI a réalisé des protocoles de tests A/B standardisés hors ligne et en ligne pour mesurer la performance du modèle. Dans ces tests, a été examiné le delta entre la prévalence des contenus préjudiciables - c'est-à-dire le pourcentage de vues de contenus contrevenants que les gens voient - avant et après le déploiement du FSL sur Facebook et Instagram. Meta AI Few-shot Learner a été capable de détecter correctement des posts que les systèmes traditionnels peuvent manquer et a ainsi contribué à réduire la prévalence de ces types de contenus préjudiciables. Il y parvient en détectant de manière proactive les contenus potentiellement préjudiciables et en les empêchant de se propager sur les plateformes. Il a également été constaté qu'en combinaison avec les classificateurs existants, le FSL a contribué à réduire la prévalence d'autres contenus préjudiciables, comme les propos haineux.

Des avancées significatives vers un modèle présenté comme ultra-performant

Les équipes de Meta AI travaillent sur des tests supplémentaires pour améliorer les classificateurs qui pourraient bénéficier de plus de données d'entraînement étiquetées, comme ceux des pays qui parlent des langues sans grands volumes de données d'entraînement étiquetées. Ces modèles d'IA intelligents et généralisés n'en sont qu'à leurs débuts. Il reste encore beaucoup de chemin à parcourir avant que l'IA puisse comprendre des dizaines de pages de texte de politique et savoir immédiatement et exactement comment l'appliquer.[caption id="attachment_34400" align="aligncenter" width="696"] Meta AI[/caption]

Meta AI[/caption]

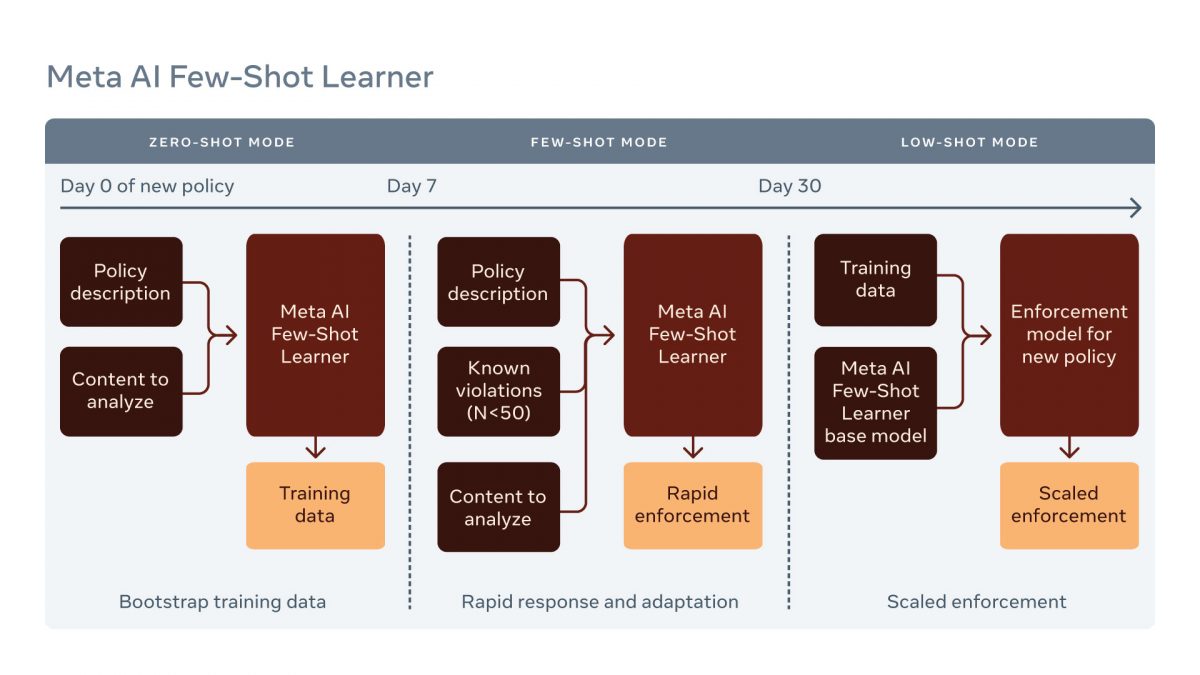

Few-Shot Learner est un modèle à grande échelle, multimodal, multilingue, qui permet la compréhension conjointe des politiques et du contenu, des problèmes d'intégrité et qui ne nécessite pas de réglage fin du modèle.

Ce nouveau système fonctionne dans trois scénarios différents, chacun d'entre eux nécessitant des niveaux variables d'exemples étiquetés :

- Zero-shot : Descriptions de politiques sans exemples.

- Peu d'exemples avec démonstration : Descriptions de politiques avec un petit ensemble d'exemples (moins de 50).

- Low-shot avec réglage fin : Les développeurs ML peuvent affiner le modèle de base FSL avec un faible nombre d'exemples d'entraînement.

Dans le cadre de cette nouvelle approche, appelée Entailment Few-Shot Learning, l'idée clé est de convertir l'étiquette de classe en une phrase en langage naturel qui peut être utilisée pour décrire l'étiquette, et de déterminer si l'exemple implique la description de l'étiquette. Par exemple, il est possible de reformuler une paire d'entrée et d'étiquette de classification de sentiments ainsi :

- [x : « I love your ethnic group. JK. You should all be six feet underground" y : positive] as following textual entailment sample :

- [x : I love your ethnic group. JK. You should all be 6 feet underground. This is hate speech. y : entailment].

Les équipes de Meta AI estiment que le FSL peut, au fil du temps, améliorer les performances de tous leurs systèmes d'intelligence artificielle en matière d'intégrité en leur permettant d'exploiter une base de connaissances uniques et partagées pour traiter de nombreux types différents de violations. Mais elle pourrait également aider les flux de travail de politique, d'étiquetage et d'enquête à combler le fossé entre la perspicacité humaine et les progrès du classificateur.

La chasse aux contenus illicites de plus en plus rapide

Le FSL peut être utilisé pour tester un nouvel ensemble de violations probables des politiques et comprendre la sensibilité et la validité des définitions proposées. Il jette un filet plus large, faisant apparaître plus de types de « presque » violations de contenu que les équipes chargées de la politique doivent connaître au moment de prendre une décision ou de formuler des conseils pour les annotateurs qui forment de nouveaux classificateurs.La possibilité de commencer rapidement à appliquer des politiques à l'encontre de types de contenu qui ne disposent pas d'un grand nombre de données d'apprentissage étiquetées constitue une avancée majeure et contribuera à rendre ces systèmes plus agiles et plus réactifs aux nouveaux défis. L'apprentissage « few-shot » et « zero-shot » est l'un des nombreux domaines de pointe de l'IA dans lesquels Meta AI a réalisé d'importants investissements de recherche. Les équipes travaillent activement sur des problèmes clés de recherche ouverte qui vont au-delà de la seule compréhension du contenu et tentent de déduire le contexte culturel, comportemental et conversationnel qui l'entoure.

Beaucoup de travail reste à faire, mais ces premiers résultats constituent une étape importante qui marque une évolution vers des systèmes d'IA plus intelligents et généralisés, capables d'apprendre rapidement plusieurs tâches à la fois.

La vision à long terme de Meta AI est d'atteindre une flexibilité et une efficacité d'apprentissage semblables à celles de l'homme, ce qui rendra leurs systèmes d'intégrité encore plus rapides et faciles à former et plus à même de travailler avec de nouvelles informations. Un système d'IA tel que Few-Shot Learner peut améliorer considérablement la capacité du géant des réseaux sociaux à détecter et à s’adapter aux situations émergentes. En identifiant les contenus évolutifs et préjudiciables beaucoup plus rapidement et avec plus de précision, FSL promet d'être une pièce essentielle de la technologie qui aidera Meta AI à continuer à évoluer et à traiter les contenus préjudiciables sur ses plateformes.