Le mois dernier, une équipe de chercheurs de l'Université de Géorgie avait réalisé une étude prouvant que les gens faisaient plus souvent confiance aux avis prononcés par un algorithme plutôt qu'à ceux proposés par une foule d'individus. Plus récemment, le National Institue of Standards and Technology (NIST) a proposé une méthode permettant d'évaluer la confiance que peuvent donner les utilisateurs aux modèles d'IA. La question abordée dans le cadre de cette étude est la suivante : quand décidons-nous de faire confiance ou non aux recommandations formulées par une machine ?

Une étude pour savoir si la confiance donnée par les humains aux machines est mesurable

Cette interrogation est la problématique principale d'un projet mené par le NIST dans l'optique d'en savoir plus sur la façon dont les humains font confiance aux systèmes d'IA. Leurs recherches ont abouti sur la publication d'un document de 23 pages rédigé par Brian Stanton du laboratoire des technologies d'information du NIST et Theodore Jensen, chercheur à l'Université du Connecticut et informaticien pour le NIST. L'étude rentre dans le cadre d'une initiative plus large du NIST qui vise à mieux comprendre les modèles d'IA de confiance.Pour répondre à cette question, Brian Stanton s'est d'abord demandé si la confiance que donnent les humains aux systèmes d'IA est quelque chose de mesurable ou quantifiable. Et si c'est le cas, comment peut-on faire pour la mesurer de manière appropriée et avec précision. C'est ce qu'il évoque dans ses déclarations :

"De nombreux facteurs sont intégrés dans nos décisions en matière de confiance. C'est la façon dont l'utilisateur pense, ressent le système et perçoit les risques liés à son utilisation."

Une première phase de recherche pour comprendre les mécanismes de la confiance

Avec l'aide de Theodore Jensen, ils ont exploité des articles scientifiques et des recherches déjà réalisées autour de la confiance et se sont appuyés sur deux axes de travail :- D'abord, ils se sont focalisés sur l'analyse du rôle intégral de la confiance dans l'histoire de l'humanité afin de comprendre comment elle a façonné nos processus cognitifs.

- Grâce à cette première étape, ils ont pu se tourner vers les défis de confiance uniquement associés à l'IA, dont les capacités vont souvent au-delà de celles des humains.

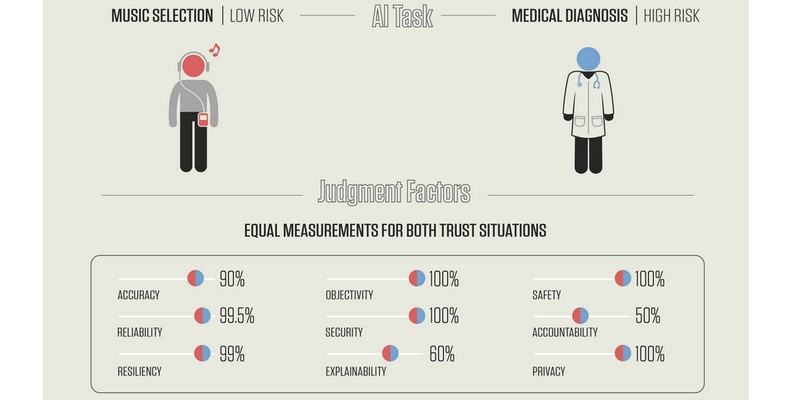

- précision

- fiabilité

- résilience

- objectivité

- sécurité

- compréhension

- sureté

- responsabilité

- confidentialité.

Les facteurs sont plus ou moins influents selon les modèles d'intelligence artificielle

Partons d'un exemple. Nous prenons le facteur "précision" dans le cadre de l'évaluation par un individu d'un algorithme sélectionnant de la musique. Une personne curieuse de découvrir de nouvelles chansons et de sortir de sa zone de confort musicale ne sera pas trop regardante sur la précision du modèle d'IA quant à sa manière de choisir une chanson ou de créer une playlist.Par contre, si le cadre concerne un système d'IA diagnostiquant le cancer, l'individu n'accordera que très peu souvent sa confiance au modèle si celui-ci n'est fiable qu'à 80 ou 90 %. Il ne sera pas très enclin à vouloir l'utiliser, surtout si l'utilisateur sait qu'il pourrait apprendre par la suite une mauvaise nouvelle. Cet exemple montre bien que ces facteurs sont plus ou moins influents selon les tâches effectuées par le système d'IA et selon sa manière de les réaliser.

À partir de ces recherches, Brian Stanton propose un modèle très particulier et demande l'avis des experts :

"Nous proposons un modèle de confiance des utilisateurs de l'IA. Tout est basé sur la recherche des autres et les principes fondamentaux de la cognition. Pour cette raison, nous aimerions recevoir des commentaires sur les travaux que la communauté scientifique pourrait poursuivre pour fournir une validation expérimentale de ces idées."L'institution propose au public et plus particulièrement à la communauté scientifique de fournir des commentaires autour du document et du projet grâce à un formulaire de réponse. Cet appel est ouvert jusqu'au 30 juillet 2021. Avec les avis recueillis et examen public, les deux chercheurs espèrent obtenir des informations plus précises pour poursuivre plus sereinement leurs recherches.

Pour plus d'informations sur l'intelligence artificielle de confiance, nous vous invitons à vous référer au magazine ActuIA N°3, dont le dossier central est consacré à ce sujet.