La société DeepMind, rachetée par Google en 2014, est parvenue à réaliser une avancée fondamentale dans le développement de l'intelligence artificielle. Les chercheurs se sont en effet focalisés sur les systèmes d'intelligence artificielle utilisant des réseaux neuronaux. Ces derniers, en dépit de leurs bonnes performances, étaient jusque là assez limités. Ils ne pouvaient en effet pas se servir de ce qu'ils avaient appris précédemment pour effectuer une nouvelle tâche, victimes de ce qu'on appelle « l’oubli catastrophique ». Même si le deep learning et l'apprentissage par renforcement avaient déjà permis des avancées, les chercheurs de DeepMind et de l’Imperial College de Londres ont réussi à aller encore plus loin.

Un problème fondamental

« L’oubli catastrophique » est donc le nom donné à ce problème particulier auquel les chercheurs étaient confrontés jusqu'à présent. Lorsqu'un réseau neuronal d'intelligence artificiel était créé, sa fonction était simple puisqu'il était conçu pour mener à bien une tâche. Mais les données acquises lors cette mission n'étaient pas réutilisables pour que cette même intelligence artificielle effectue une autre tâche par la suite.

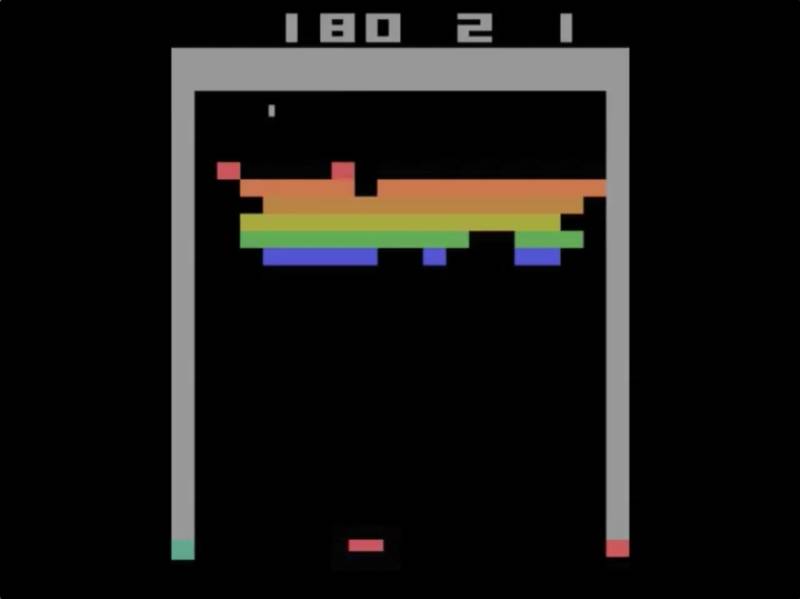

DeepMind constatait particulièrement ce phénomène lorsque l'intelligence artificielle essayait de terminer un jeu vidéo comme Space Invaders, Pong, etc. Elle finissait par remporter le jeu avec brio mais si on lui demandait d'effectuer une nouvelle tâche ou de jouer à un autre jeu, il fallait impérativement repasser par tout le processus d'apprentissage. L'intelligence artificielle s'avérait incapable de mémoriser ce qu'elle avait appris et d'utiliser ces connaissances dans un autre contexte.

Les neurosciences à la rescousse

L'impact des neurosciences dans les avancées en terme d'intelligence artificielle est indéniable et, de nouveau, les chercheurs, autant de DeepMind que de l’Imperial College, ont su s'en inspirer. Plus concrètement, ils ont étudié le fonctionnement de la mémoire humaine dans les processus d'apprentissage.En neuroscience, on distingue deux types de consolidation du savoir:

-

La consolidation systématique

-

La consolidation synaptique

L'algorithme EWC (Elastic Weight Consolidation)

Après chaque phase d'apprentissage, L'intelligence artificielle de DeepMind va définir le poids, et donc l'importance, de chaque connexion neuronale dans la réalisation de la tâche effectuée. La connexion va alors être consolidée et protégée. Ce faisant, l'intelligence artificielle va chercher à préserver le savoir, tout en lui permettant d'évoluer.La variation dans l'importance des connexions a permis de créer l'Algorithme EWC : Elastic Weight Consolidation. L'intelligence artificielle pèse en effet chaque connexion et plus celle-ci est importante, plus elle va la protéger, la consolider, et éviter qu'elle soit altérée par la suite.

Les systèmes d'intelligence artificielle dotés de cet algorithme peuvent désormais effectuer différentes tâches à la suite. Elles n'oublient plus et n'ont donc pas besoin de recommencer chaque fois de zéro. En effet, elles apprennent désormais de manière séquentielle et peuvent mettre à profit des connexions neuronales consolidées auparavant pour venir à bout d'un nouveau jeu par exemple.

Même si nous sommes encore loin d'une intelligence artificielle qui pourrait tout faire et tout mémoriser, cet algorithme EWC est un pas de géant vers un apprentissage en temps réel selon les informations soumises. "L'oubli catastrophique" est en passe de devenir un problème du passé, car bientôt nous pourrons sûrement produire des intelligences artificielles dotées de processus d'apprentissage plus efficaces et plus souples.