Hier était donné le coup d'envoi de l'événement annuel Google I/O organisé par Google pour annoncer ses nouveautés aux développeurs. L'événement fait comme d'habitude la part belle à l'intelligence artificielle.

Pour les plus pressés, nous avons publié une vidéo résumant ces annonces :

https://www.youtube.com/watch?v=gg1pxqM-q9o&feature=youtu.be

(Attention : le téléphone utilisé à des fins illustratives dans cette vidéo et sur lequel est affiché le comparatif de rendu photo Phone X / Pixel 3a en conditions de basses luminosité n'est bien sûr pas un Pixel 3a mais un iPhone. Vous trouverez les spécifications détaillées du Pixel 3a sur The Verge)

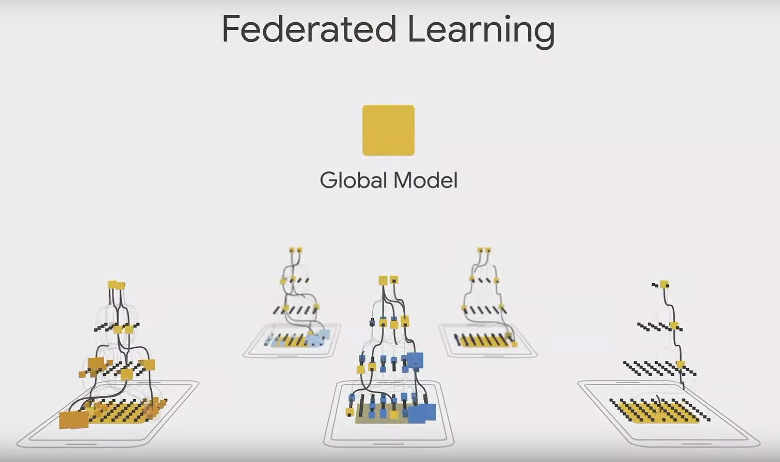

Google mise sur le Federated Learning pour préserver la confidentialité des données en matière de Deep Learning

Pour être performante, l'intelligence artificielle basée sur le Deep Learning doit exploiter de très grandes quantités de données préalablement collectées. Ces données sont indispensables dans la phase d'apprentissage des réseaux de neurones (à l'exception de modèles reposant sur l'apprentissage par renforcement, dit Reinforcement Learning). Hors, le sujet de la collecte de données est une grande source de préoccupation au sein du public.Google a imaginé en 2017 une solution astucieuse : le Federated Learning.

Le Federated Learning (43:20 dans la vidéo) permet de faire de l'apprentissage machine distribué : les données présentes sur les terminaux permettent de réaliser un apprentissage machine via une version légère de TensorFlow embarquée sur ces terminaux. C'est le résultat des paramètres d'apprentissage qui est ensuite envoyé vers les serveurs Google afin d'alimenter un réseau de neurones global qui centralise les apprentissages réalisés par l'ensemble des utilisateurs. Les données utilisées pour l'apprentissage ne quittent donc à aucun moment le téléphone de son propriétaire. Lire notre article détaillé sur le Federated Learning.

Google crée des versions de ses modèles de langages embarquables sur les terminaux.

En créant des modèles de langages légers (0.5Gb contre 100Gb pour ses modèles traditionnels), Google est désormais capable des les déployer sur les terminaux. Cela signifie que les nouvelles versions de l'assistant embarquant ces modèles de langage n'auront plus besoin de faire des requêtes vers les serveurs Google pour interpréter les commandes vocales. Cette évolution majeure vient elle aussi répondre à la principale critique faite aux assistants vocaux : le manque de garantie du respect de la vie privée.Un autre avantage est une amélioration de la réactivité de l'assistant grâce à la suppression du délai de transit des données. Ainsi, Sundar Pichai annonce un temps de réponse divisé par 10, ce qui permet d'imaginer de nouveaux usages pour l'assistant, et notamment, une utilisation fluide des applications Android en commandes vocales (démonstration vidéo à l'appui à 25:43).

Notons que la nouvelle génération de l'assistant Google sera proposée sur les futurs téléphones Google Pixel qui seront disponibles dans le courant de l'année.

Reconnaissance vocale

Avec la nouvelle fonctionnalité, LiveCaption, les terminaux Android pourront faire du sous-titrage en temps réel. A la différence du sous-titrage vidéo proposé par Youtube, celui-ci est exécuté directement par le terminal, ce qui le rend compatible avec les autres applications, notamment les lecteurs de podcasts.Avec LiveRelay, Google propose un assistant interprète Vocal <-> Ecrit sous forme de chat, permettant de passer des appels téléphoniques. Les propos de l'interlocuteur sont retranscrits en temps réel sous forme de texte. Il suffit de lui répondre depuis la fenêtre de Chat pour que la synthèse vocale de Google se fasse notre relai. Un outil extrêmement utile à l'accessibilité des personnes atteintes de surdité, mutisme ou troubles de la parole.

Compréhension des personnes atteintes de troubles de la parole : Parallèlement, Google cherche à améliorer les performances de la reconnaissance vocale de personnes atteintes de troubles de l'élocution et les invite à founir des échantillons sonores sur g.co/euphonia

Smartphone

Le téléphone Google Pixel 3a, pour lequel Google fait le choix assumé de réduire les coûts en privilégiant les traitements logiciels à l'intégration de matériels couteux, notamment en terme d'optiques et capteurs photos, sera commercialisé au prix de 399$. Comme ses prédécesseurs, le Pixel 3a excelle (pour son prix) grâce à l'intelligence artificielle en matière de traitement de photos en conditions de faible luminosité.Santé

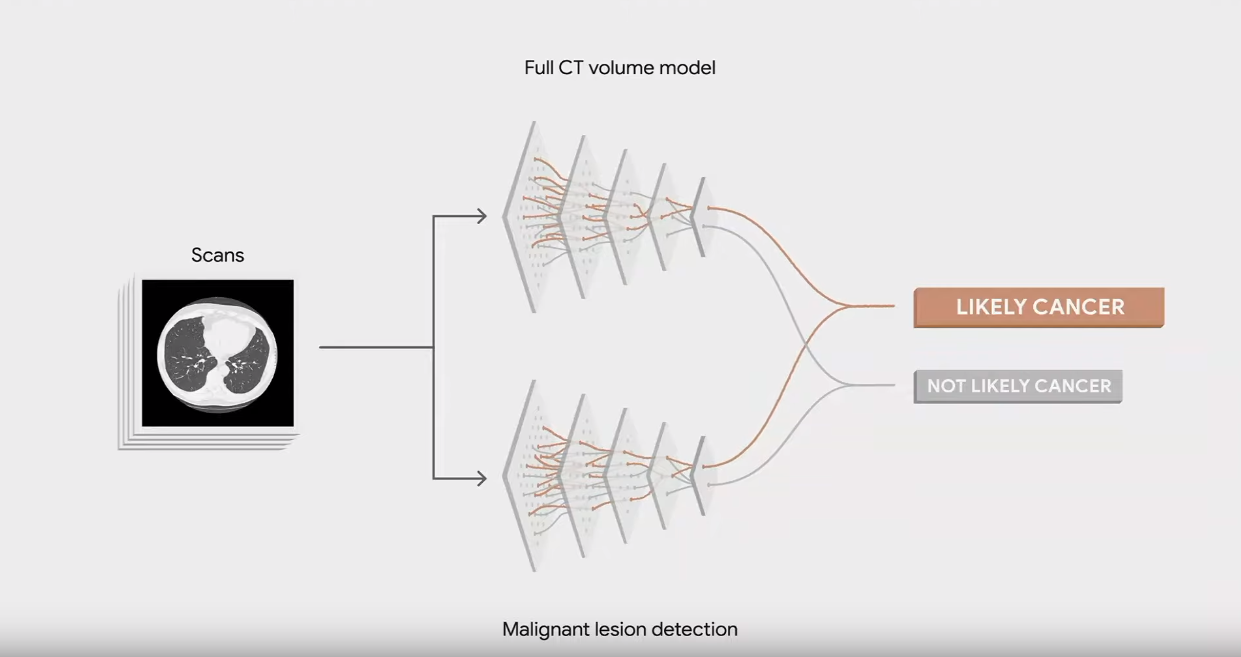

Lily Peng indique que Google s'apprête à publier une recherche sur la prédiction de cancer des poumons. Selon les premiers résultats, le modèle est parvenu à prédire un cancer des poumons 1 an avant qu'il ne soit diagnostiqué.