Les travaux de Raphaël-David Lasseri, David Regnier, Jean-Paul Ebran et Antonin Penon, théoriciens du CEA, de l’Irfu à la DRF (Espace de Structure Nucléaire Théorique) et du service de physique nucléaire à la DAM, ont fait l’objet cette année d’une publication dans la revue Physical Review Letters, l’article figure parmi les suggestions de l’éditeur. Les chercheurs ont développé une intelligence artificielle permettant la prédiction des propriétés du noyau atomique. Ils ont ainsi simulé les propriétés de plus de 1800 noyaux atomiques à partir d’un algorithme entraîné sur un sous-ensemble de seulement 210 noyaux.

Ces 210 noyaux ont été choisis automatiquement par l’IA en utilisant une approche dite d’apprentissage actif, une première. Il s’agit d’une avancée majeure en comparaison des approches précédentes qui se limitaient à la prédiction d’une seule observable (grandeur physique mesurable, comme par exemple la masse) et dont la portée prédictive était très faible. Les résultats obtenus sont d’une précision comparable à celle des calculs issus de l’état de l’art des techniques utilisées en physique nucléaire théorique, et cela en un temps de calcul significativement réduit (un gain allant d’un facteur 10 à un facteur 10³ en fonction du type de résultat voulu).

La compréhension de la structure et de la limite d'existence des noyaux atomiques est une question essentielle et difficile à traiter. Elle est pourtant nécessaire pour déterminer l'origine des éléments lourds dans notre galaxie ainsi que pour découvrir de nouveaux éléments super-lourds. Motivée par la progression rapide de l'apprentissage automatique au cours des 10 dernières années, l’étude avait pour objectif d’examiner, pour la première fois, la capacité d'une IA à appréhender la physique des structures nucléaires à basse énergie dans son ensemble.

Les fonctionnelles de densité d’énergie : une approche théorique qui a fait ses preuves

Parmi les différentes approches théoriques visant à fournir une description universelle des observables nucléaires, comme la masse, le rayon ou le spectre en énergie d’excitation d’un noyau, seul le cadre des fonctionnelles de densité d'énergie (EDF), est actuellement capable de fournir une description complète et précise des propriétés du noyau atomique.

Cette approche théorique décrit les interactions entre les nucléons, c’est-à-dire les protons et neutrons composant le noyau, comme fonction de la densité du système. En particulier, les approches les plus récentes, dites EDF Multi-références (MR-EDF), fournissent des prédictions d’observables précises et universelles au détriment d’une augmentation très conséquente des temps de calculs.

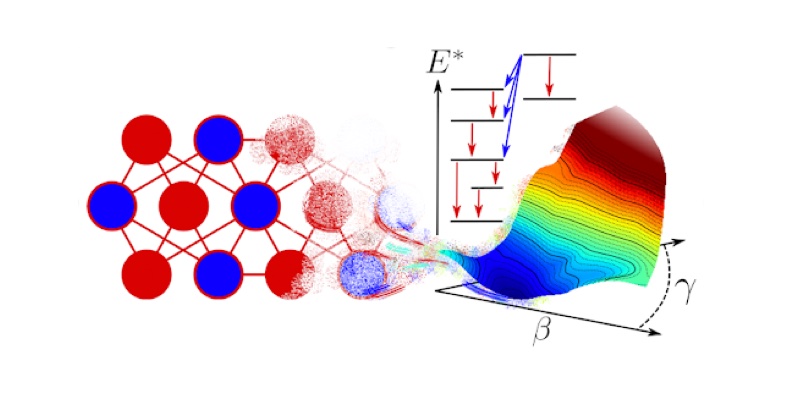

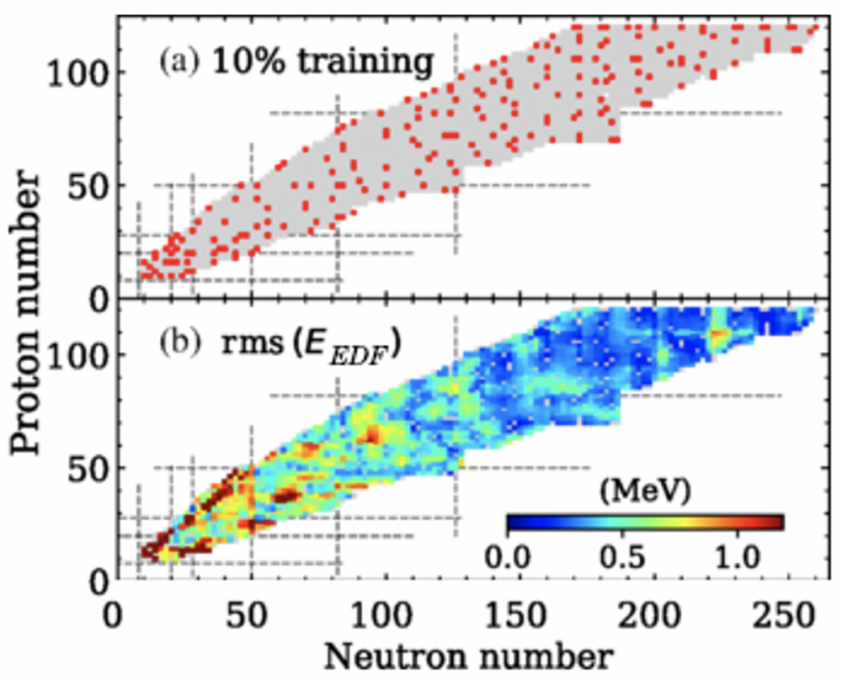

[caption id="attachment_25575" align="alignnone" width="1000"] Figure 1. Illustration des calculs opérés par les réseaux de neurones, de la spectroscopie nucléaire - ici représentée par un schéma des niveaux d’énergie d’excitation (E*) du noyau - aux surfaces d'énergie potentielle qui représente l’énergie du noyau en fonction de paramètres de déformation ( β et γ).[/caption]

Figure 1. Illustration des calculs opérés par les réseaux de neurones, de la spectroscopie nucléaire - ici représentée par un schéma des niveaux d’énergie d’excitation (E*) du noyau - aux surfaces d'énergie potentielle qui représente l’énergie du noyau en fonction de paramètres de déformation ( β et γ).[/caption]

Aussi, le déploiement à grande échelle des EDF nucléaires est associé à un coût numérique lourd, se traduisant par des temps de calculs particulièrement conséquents (à titre d’exemple, pour calculer l’ensemble des propriétés nucléaires sur l’ensemble de la carte il faut quelques millions d’heures CPU). Un tel coût est prohibitif dans plusieurs situations, par exemple dans le cas d’une étude systématique de la variation des observables prédites sur l’ensemble de la carte nucléaire en fonction de différentes paramétrisations de l’interaction EDF (étude particulièrement importante pour des applications astrophysiques, comme l’étude de la nucléosynthèse primordiale nécessitant le calcul de larges volumes de données nucléaires pour plusieurs centaines d’isotopes). Ainsi, l’ajustement d’une interaction au niveau MR-EDF n'a finalement été entrepris qu'une seule fois jusqu’à présent (travail réalisé par des équipes du CEA DAM).

Pour pallier à ce problème, des approches numériques alternatives ont été proposées, en particulier certaines faisant appel à l’IA.

Les premiers pas de l’IA pour la structure nucléaire

Dès 2006, Athanassopoulos et ses collaborateurs ont proposé d’utiliser un réseau de neurones simple pour prédire des tables de masses nucléaires. Cette étude initiale n’avait pas pour objectif d’être prédictive sur une large plage de la carte des noyaux. Elle ne prédisait que 10 % d’entre eux, 90 % des mesures de masses expérimentales étant utilisées pour l’entrainement du réseau neuronal. Ces prédictions étaient toutefois relativement précises avec un écart moyen à l’expérience de 950 keV (c’est à dire un écart relatif à l’expérience d’environ 1 % pour l’Oxygène 16 par exemple). De plus, modulo la phase d’entrainement numériquement lourde (effectuée en quelques heures sur carte graphique/GPU), la phase de prédiction des masses inconnues (l’inférence du réseau neuronal) est bien plus rapide qu’un calcul EDF classique.Depuis, plusieurs études ont suivi les travaux pionniers d’Athanassopoulos, mais elles présentent toutes deux points communs qui limitent considérablement leur portée, i) L’utilisation d’une grande quantité de données pour la phase d’entrainement des réseaux de neurones (de l’ordre de 80 % des données disponibles) ii) La focalisation sur une seule observable expérimentale prédite (masse ou rayon du noyau principalement). En cela, ces approches d’IA se limitent à interpoler (ou à extrapoler) certaines mesures expérimentales et ne sont donc pas compétitives par rapport aux résultats des approches EDF.

Une nouvelle approche

Les chercheurs du CEA ont donc proposé une nouvelle approche : un algorithme qui n’apprend pas une observable mais plusieurs grandeurs intermédiaires calculées par un code EDF classique. Par exemple les grandeurs quantifiant la façon dont les noyaux répondent à des déformations ou à des vibrations. L’idée est, qu’en fournissant une représentation suffisante des divers comportements physiques possibles du noyau, on permettra à ce réseau de neurones d’apprendre une représentation complète, dépassant donc la simple interpolation de résultats expérimentaux.Contrairement aux approches antérieures, une des exigences de cette étude était de minimiser la fraction des noyaux utilisés pour l’entrainement, en se limitant à 10 % (soit 210 noyaux) des noyaux disponibles. De plus, la constitution de cet ensemble de noyaux utilisés pour l’entrainement pose une question d’intérêt physique majeur. Quels sont les noyaux les plus importants pour retranscrire la physique nucléaire de basse énergie dans son ensemble ?

Pour répondre de manière complète à cette question, une approche dite d’apprentissage actif a été développée. L’objectif de cette méthode est de déterminer automatiquement quels noyaux de l’ensemble d’entrainement fournissent le plus d’informations au réseau de neurones afin de maximiser son pouvoir prédictif. Ici, un comité de réseaux de neurones (un ensemble de réseau de neurones dont les paramètres initiaux sont tirés aléatoirement, à l’instar d’une méthode de Monte-Carlo généralisée) est utilisé afin de construire itérativement l’un des ensembles de 210 noyaux permettant d’obtenir la meilleure prédiction sur les 90 % des noyaux restants à prédire. Ensuite on utilise cet ensemble de noyaux pour entrainer le réseau de neurones à prédire les variables physiques issues d’une théorie EDF. Enfin les grandeurs prédites par les réseaux sont mises en commun pour prédire l’ensemble des observables d’intérêt pour l’étude de la structure nucléaire, par exemple les énergies des premiers états excités de n’importe quel noyau.

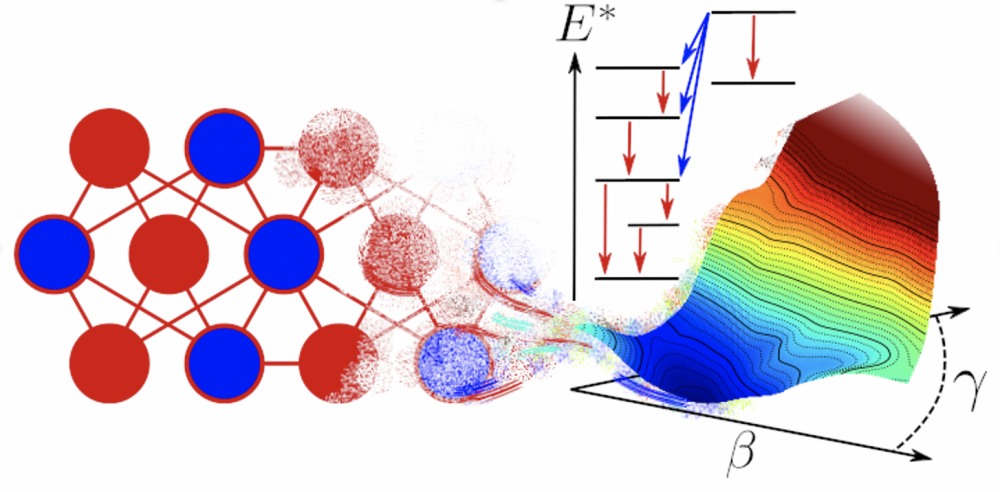

[caption id="attachment_25574" align="alignnone" width="1000"] Figure 2 : Spectre d'excitation de l’178Os (composé de Z = 76 protons et N = 102 neutrons) obtenu à partir des calculs IA (AI) et EDF . Le spectre expérimental (Exp.), extrait de la base de données ENSDF est également représenté.[/caption]

Figure 2 : Spectre d'excitation de l’178Os (composé de Z = 76 protons et N = 102 neutrons) obtenu à partir des calculs IA (AI) et EDF . Le spectre expérimental (Exp.), extrait de la base de données ENSDF est également représenté.[/caption]

Résultats

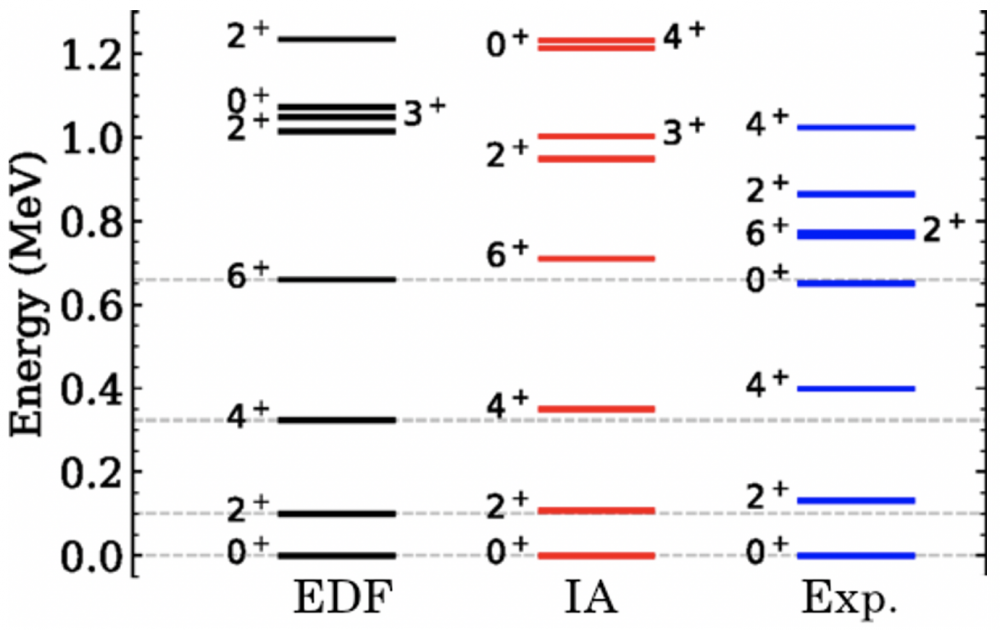

Pour la toute première fois, un algorithme constitué d’un comité de réseaux de neurones s’est avéré en mesure d'estimer la structure à basse énergie de tous les noyaux. Des performances remarquables sont obtenues, à savoir par exemple une valeur de l’écart moyen à l’énergie des états fondamentaux EDF de seulement 716 keV (rms) (Soit moins de 0.5 % d’erreur pour l’Osmium 178).Cela pour un apprentissage sur un ensemble d’entrainement des seuls 210 noyaux automatiquement sélectionnés comme les plus représentatifs de la physique de l’ensemble de la carte nucléaire. De plus, la répartition des noyaux automatiquement sélectionnés est globalement cohérente avec l’intuition physique avec une représentation importante des noyaux légers ainsi que des noyaux proches des drip-lines.

Enfin, il est important de noter qu’une fois le réseau entrainé sur l’ensemble des noyaux d’entrainement, la prédiction de l’ensemble des observables sur toute la carte ne prend que quelques millisecondes contre plusieurs centaines d’heures CPU en cas de calcul EDF direct. Il est donc à présent possible de ne réaliser que ~200 calculs EDF avant de pouvoir généraliser les résultats d’une fonctionnelle sur toute la carte tout en conservant une très bonne précision par rapport à l’expérience.

[caption id="attachment_25576" align="alignnone" width="696"] Figure 3 : En panel (a) les points rouges représentent les noyaux composant l'ensemble d'entrainement obtenus par apprentissage actif. En panel (b) la répartition sur la carte de l'écart moyen sur l'énergie de l'état fondamental entre l'énergie prédite par l'IA et celle servant de référence EDF.[/caption]

Figure 3 : En panel (a) les points rouges représentent les noyaux composant l'ensemble d'entrainement obtenus par apprentissage actif. En panel (b) la répartition sur la carte de l'écart moyen sur l'énergie de l'état fondamental entre l'énergie prédite par l'IA et celle servant de référence EDF.[/caption]

Un futur prometteur pour les approches IA appliquées à la structure nucléaire

Ces travaux ouvrent désormais la voie à de nombreuses améliorations et utilisations d’algorithmes d’IA au service de la description théorique des noyaux atomiques. Dans un premier temps, au vu du gain conséquent du temps de calcul, il devient désormais possible d’utiliser ces algorithmes pour construire rapidement de nouvelles EDF prenant en compte un grand nombre d’observables expérimentales (masses, rayons, mais également caractéristiques de l’état fondamental et des états excités).Cette approche est particulièrement importante pour les applications astrophysiques et est d’ores et déjà en cours d’évaluation par une collaboration franco-belge. Au-delà de ces applications directes, il devient également envisageable d’utiliser des réseaux de neurones pour fournir des points de départs de bonne qualité pour des calculs de dynamique nucléaire, pour l’étude de la fission notamment.

Enfin, le succès de cette approche est une première preuve de principe qu'un comité de réseau de neurones est capable de coder plusieurs aspects corrélés de la déformation nucléaire. Les réseaux de neurones impliqués possèdent probablement une représentation interne non triviale satisfaisante de la physique du système. L'étude de cette représentation peut révéler de nouveaux concepts physiques saisis lors de l'apprentissage.

À plus grande échelle, les informations que l'on peut extraire d’un algorithme d’IA, sur la représentation d'un problème physique complexe, est une question clé à la croisée de la physique et de la théorie de la représentation.

Référence

[1] R-D. Lasseri, D. Regnier, J-P. Ebran, and A. Penon, Phys. Rev. Lett. 124, 162502 (2020)Contacts

Raphaël LasseriDavid Regnier

Cet article publirédactionnel est publié dans le cadre d'une collaboration commerciale