L'intelligence artificielle soulève de nombreuses questions, notamment éthiques et morales. Une équipe de chercheurs du MIT a créé il y a un an le site Moral Machine qui reprend le dilemme du tramway adapté à la voiture autonome. Ces tests, auxquels tout le monde peut participer, ont permis la création d'une intelligence artificielle capable de faire des choix moraux.

Le dilemme du tramway adapté à la voiture autonome

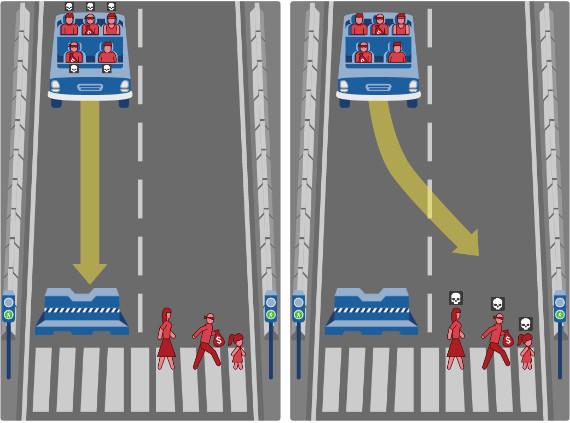

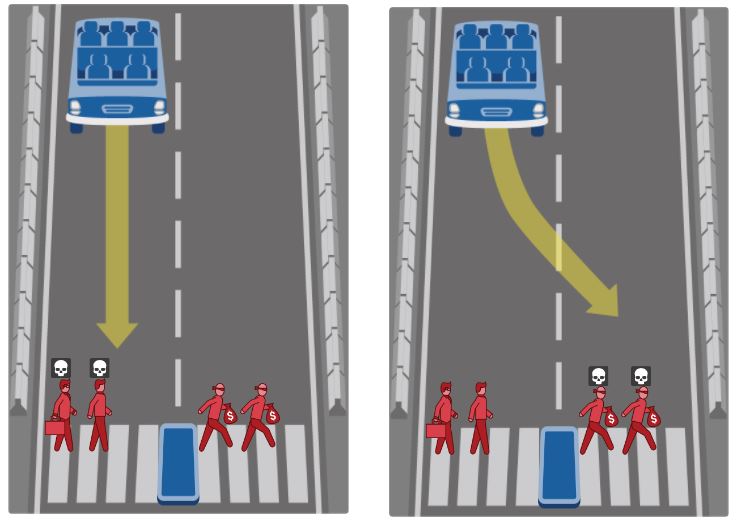

Le dilemme du tramway est une expérience de pensée utilisée notamment en sciences cognitives et en éthique. Décrite en 1967 par Philippe Foot, elle a été analysée par la suite par Judith Jarvis Thomson, Peter Unger et Frances Kamm. Il s'agit d'imaginer un tramway ne pouvant pas s'arrêter, vous pouvez seulement actionner un levier permettant au train d'aller sur des voies à droite ou à gauche. Dans les deux cas cela entraîne la mort d'un ou de plusieurs personnes. Vous devez donc décider comment il convient d'agir.Sur leur site Moral Machine, les chercheurs du MIT ont donc reproduit ce dilemme avec une voiture autonome. Doit-elle choisir la voie de gauche ou celle de droite? Qui doit-elle sacrifier, quelle loi doit-elle suivre? Qu'est-ce qui est plus éthique?

[caption id="attachment_2838" align="alignnone" width="737"] Moral Machine[/caption]

Moral Machine[/caption]

Dans un article de The Outline, Iyad Rahwan, chercheur au MIT à l'origine du projet Moral Machine, et Ariel Procaccia, professeur à Carnagie Mellon, expliquaient comment ils ont créé une IA à partir des réponses à ce test.

Une intelligence artificielle pouvant prendre des décisions après évaluation de la situation

Environ 18 millions de votes ont été validés sur la plate-forme et les créateurs de Moral Machine estiment que près de 1,3 millions de personnes ont voté. Le succès a été tel que les données enregistrées ont servi à Iyad Rahwan et Ariel Procaccia pour créer une IA pouvant évaluer une situation avant de prendre une décision. Celle-ci se base sur un algorithme conçu à partir des choix des participants à Moral Machine.Le machine learning a permis aux deux chercheurs de développer leur IA pour qu'elle puisse également comprendre par elle-même. Ainsi, si l'IA n'est pas familière d'une situation, elle peut tout de même l'analyser. Ariel Procaccia expliquait toutefois à The Outline:

"Nous ne disons pas que le système est prêt à être utilisé en conditions réelles. Mais c’est une démonstration de faisabilité, qui montre que la démocratie peut aider dans les grandes problématiques éthiques qui existent sur la conception de l’IA."Selon les chercheurs, leur intelligence artificielle reflète les choix des participants. S'ils ont préféré laisser mourir une personne plutôt que cinq, le choix de l'IA sera donc conforme au choix humain. Vous pouvez toujours participer au test et prendre part à ce débat.