TLDR : La missione internazionale "ICHIBAN" condotta dall'agenzia spaziale tedesca (DLR) e l'agenzia giapponese di esplorazione aerospaziale (JAXA) ha avuto successo nel far comunicare e cooperare due robot di assistenza agli astronauti a bordo della ISS. Questa impresa, che apre prospettive per le interazioni robotiche in ambiente orbitale, rappresenta un importante progresso in vista delle future missioni lunari e marziane.

L'agenzia spaziale tedesca (DLR) e l'Agenzia spaziale giapponese per l'esplorazione aerospaziale (JAXA) annunciano che la missione di cooperazione internazionale "ICHIBAN" è stata coronata dal successo. Per la prima volta, due robot di assistenza agli astronauti provenienti da programmi nazionali distinti hanno comunicato e cooperato in orbita a bordo della ISS.

Uno degli obiettivi della missione ICHIBAN (prima in giapponese), che si è conclusa il 29 luglio scorso, era di testare la coordinazione di diversi robot distinti operanti simultaneamente e in tempo reale a bordo della ISS.

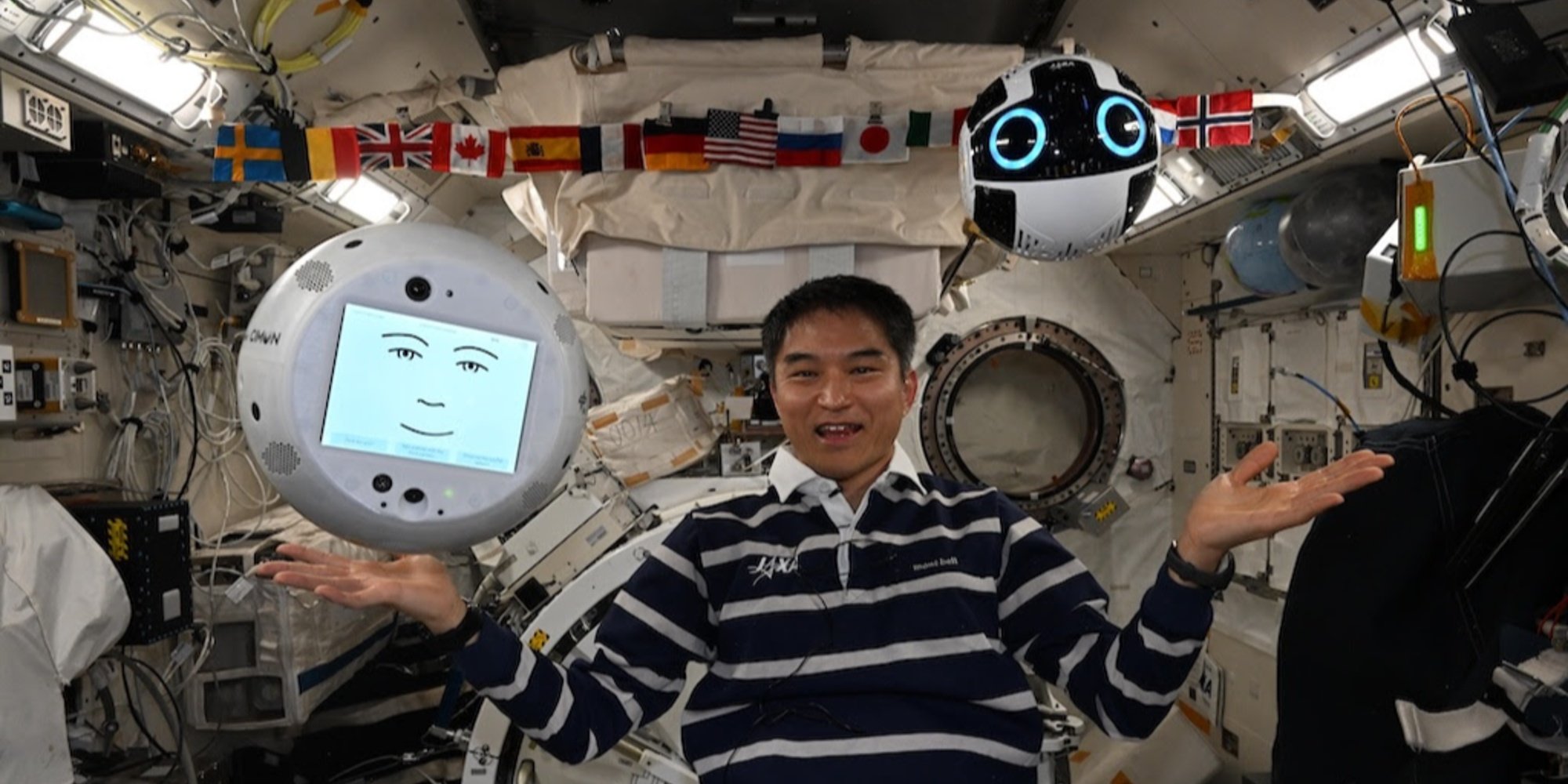

I due robot coinvolti nell'esperimento sono CIMON, sviluppato da DLR, Airbus e IBM, e Int-Ball2, concepito da JAXA, installati rispettivamente nei moduli di sperimentazione europeo Columbus e giapponese Kibo.

Distribuito per la prima volta nel 2018, CIMON (Crew Interactive Mobile Companion) è un robot sferico, delle dimensioni di un pallone, stampato in 3D, alimentato dalle tecnologie vocali e cognitive di watsonx, la piattaforma IA di IBM. Durante la missione ICHIBAN, CIMON è stato operato da BIOTESC, il centro svizzero dell'ESA specializzato nelle operazioni scientifiche a bordo della stazione internazionale.

Da parte sua, Int-Ball2 è un'evoluzione del primo drone telecamera di JAXA. Integrato dal 2023 nel modulo giapponese, permette alla cellula di controllo a terra a Tsukuba (Giappone) di filmare a distanza le attività degli astronauti, ottimizzando così la documentazione scientifica senza mobilitare l'equipaggio della stazione spaziale internazionale. Fino ad ora, non era stata prevista alcuna capacità di interazione con altri robot.

La dimostrazione è stata condotta da Takuya Onishi, astronauta della JAXA a bordo della ISS. Dal modulo Columbus, ha trasmesso comandi vocali a CIMON, che ha servito da interfaccia linguistica intelligente. L'istruzione è stata elaborata dalla piattaforma watsonx di IBM, prima di essere tradotta in comandi operativi indirizzati a Int-Ball2.

Quest'ultimo ha quindi navigato nel modulo Kibo per cercare e localizzare vari oggetti nascosti: un Cubo di Rubik, un martello, diversi cacciaviti e una vecchia versione di Int-Ball fuori servizio. Ha poi trasmesso le immagini in diretta allo schermo di CIMON, permettendo a Onishi di verificare visivamente la loro posizione a distanza.

Credito: JAXA/DLR;

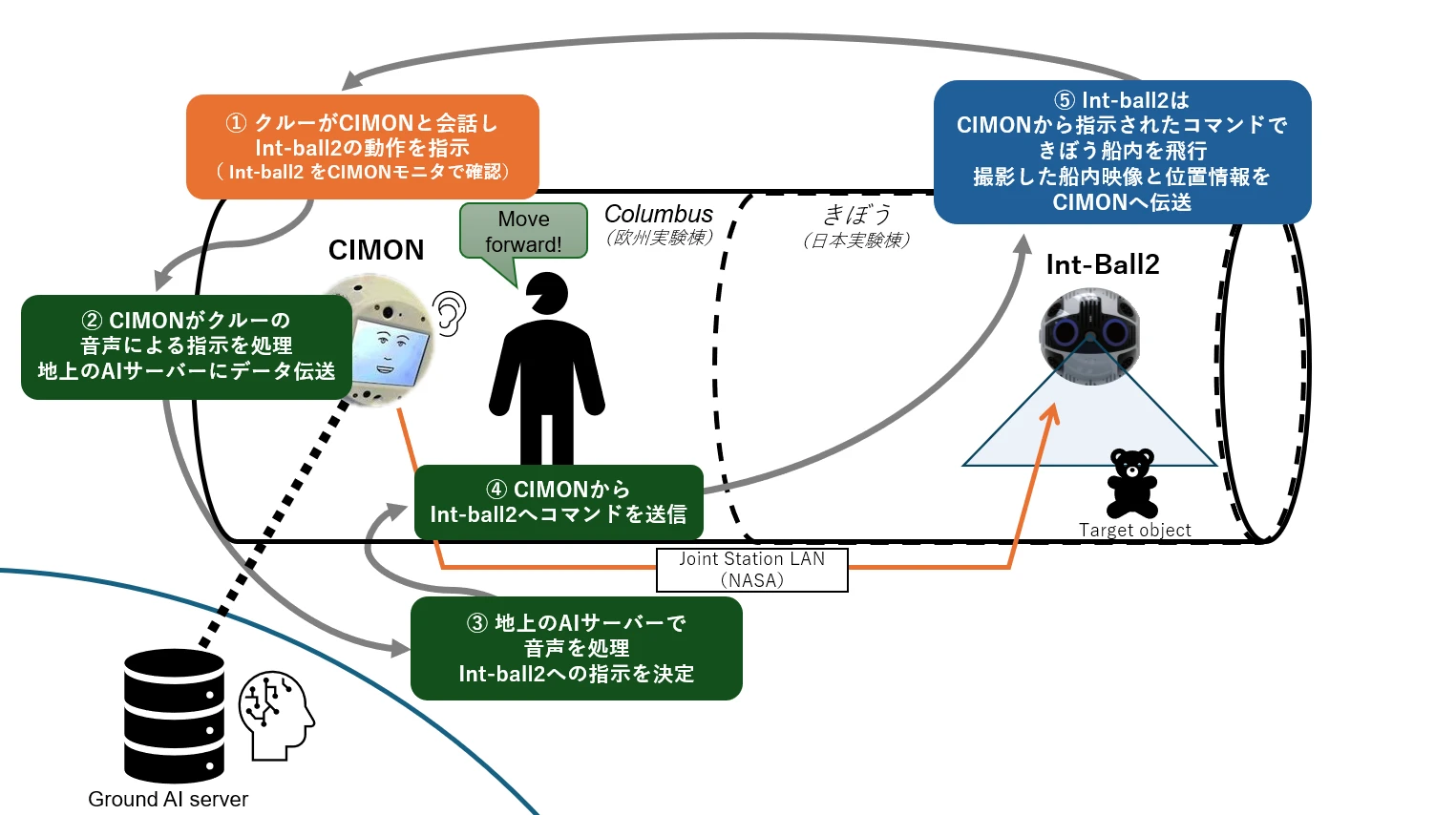

Illustrazione Tabella di collaborazione della missione ICHIBAN

Illustrazione Tabella di collaborazione della missione ICHIBAN

L'astronauta dà un'istruzione vocale a CIMON affinché Int-Ball2 esegua un compito (fase ①). CIMON trasmette questo comando vocale a un server di IA situato a terra, che analizza l'intenzione del comando (fasi ② e ③). Ritorno d'istruzione verso la ISS: una volta trattato, il comando è rinviato dalla terra tramite la rete LAN della stazione (Joint Station LAN/NASA) a CIMON, che lo trasmette a Int-Ball2 (fase ④). Quest'ultimo agisce di conseguenza nel modulo giapponese "Kibo", esegue il suo compito (ad esempio, localizzare un oggetto), quindi invia le immagini e i dati di posizione a CIMON.

L'innovazione risiede nel fatto che, fino ad ora, le immagini catturate da Int-Ball2 potevano essere trasmesse solo al centro di controllo di Tsukuba. La possibilità di inviarle in tempo reale a un altro robot a bordo apre un nuovo campo per le interazioni robotiche distribuite in ambiente orbitale.

Un primo passo che assume tutta la sua importanza in vista delle future missioni lunari e marziane.