TLDR : Mistral AI startet mit Voxtral in den Open-Source-Sprachmodellmarkt, bietet leistungsfähige Modelle für verschiedene Anwendungen und plant zukünftige Erweiterungen.

Inhaltsverzeichnis

Letzten Dienstag kündigte Mistral AI die Einführung von Voxtral an, seiner ersten Familie von Open-Source-Audiomodellen. Diese für professionelle Anwendungen entwickelten Sprachverständnismodelle markieren den Eintritt des französischen Einhorns in das strategische Segment der Sprachintelligenz, einem Bereich, der bisher von Akteuren wie OpenAI, Meta und Google dominiert wurde.

Die Voxtral-Reihe umfasst zwei Hauptmodelle: Voxtral Small (24 Milliarden Parameter) und Voxtral Mini (3 Milliarden Parameter), die jeweils für unterschiedliche Umgebungen konzipiert sind. Das Small-Modell ist für komplexe Anwendungsfälle und groß angelegte Cloud-Bereitstellungen konzipiert, während die Mini-Version für eingebettete oder ressourcenbeschränkte Bereitstellungen vorgesehen ist. Mistral AI bietet auch Voxtral Mini Transcribe an, eine optimierte Version ausschließlich für die Sprachtranskription, die ein besseres Preis-Leistungs-Verhältnis als Modelle wie Whisper bietet.

Funktionen, die über die Transkription hinausgehen

Voxtral soll eine Alternative zu unzuverlässigen ASR-Systemen (automatische Spracherkennung) und teuren, proprietären API-Lösungen bieten.

Es ist darauf ausgelegt, lange Audio-Kontexte zu verarbeiten und kann dank eines Fensters von 32.000 Tokens bis zu 30 Minuten Transkription oder 40 Minuten Verständnis bewältigen.

Basierend auf der Architektur des Sprachmodells Mistral Small 3.1 kann es auf mündliche Anfragen reagieren, Zusammenfassungen aus Audiodateien erstellen oder eine mündlich ausgedrückte Absicht in einen API-Aufruf oder Backend-Flow umwandeln. Das Modell unterstützt die am häufigsten verwendeten Sprachen, darunter Englisch, Spanisch, Arabisch, Französisch, Portugiesisch, Hindi, Deutsch, Niederländisch und Italienisch.

Spitzenleistung

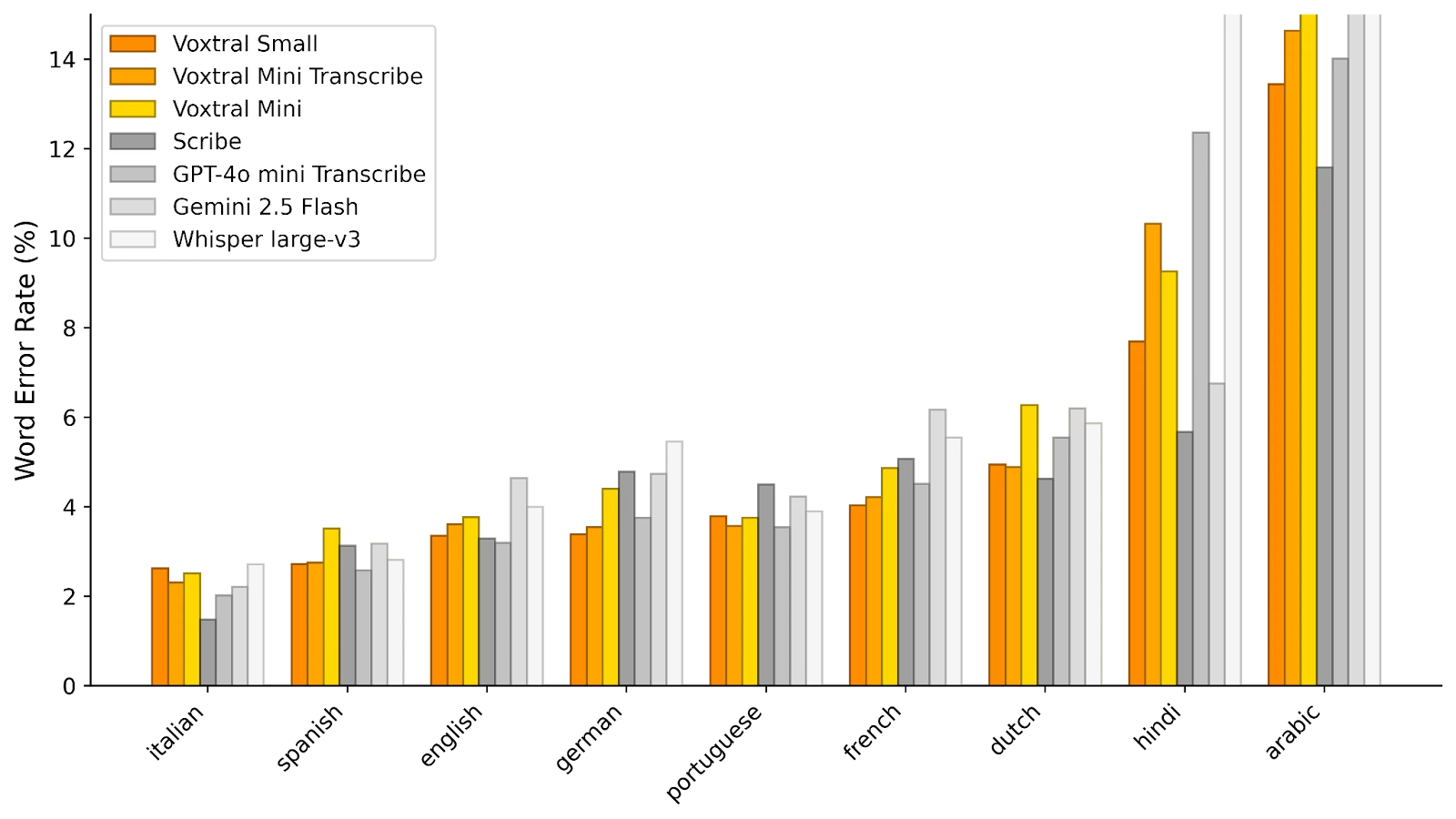

Laut den ersten von Mistral kommunizierten Bewertungen übertrifft Voxtral Small das Referenzmodell Whisper v3, aber auch Gemini 2.5 Flash und GPT-4o Mini Transcribe von Open AI in mehreren Metriken der automatischen Transkription, während es einen kontrollierten Ressourcenverbrauch aufweist.

In FLEURS (unten) zeigt Voxtral Small Spitzenleistungen in allen getesteten Sprachen, mit einer höheren Präzision als Whisper.

© Mistral AI

Bei Sprachübersetzungsaufgaben ist Voxtral Small wettbewerbsfähig mit GPT-4o Mini und Gemini.

Verfügbarkeit

Die beiden Modelle, die unter der Apache 2.0-Lizenz vertrieben werden, stehen zum Download auf Hugging Face zur Verfügung. Voxtral ist auch über API ab 0,001 $/Minute verfügbar für diejenigen, die es in ihre Anwendung integrieren möchten, was weniger als die Hälfte der Kosten konkurrierender Angebote beträgt, und wird in Kürze den Conversational Assistant von Mistral AI, Le Chat, bereichern.

Für spezifische Geschäftskontexte können Unternehmen auf private und sichere Bereitstellungen zurückgreifen, insbesondere in den juristischen oder medizinischen Bereichen.

Mistral AI plant, in den kommenden Monaten neue Funktionen wie Audiosegmentierung, Diarisierung (Identifizierung verschiedener Sprecher) oder Emotionserkennung hinzuzufügen.

Ein wachsender Markttrend

Diese Markteinführung erfolgt zu einem Zeitpunkt, an dem die Nachfrage nach Transkriptions- und Audioanalyse-Lösungen stark wächst, mit einer Beschleunigung der Anwendungsfälle im Kundensupport, der Interaktionsanalyse, der automatisierten Dokumentation oder der Sprachassistenz. Voxtral fügt sich in einen Bereich ein, der bereits von Initiativen wie Whisper (OpenAI, MIT), SeamlessM4T (Meta, nicht kommerziell) oder Frameworks wie NVIDIA NeMo oder ESPnet besetzt ist.

Aber nur wenige von ihnen bieten derzeit eine freie Zugänglichkeit, ein integriertes semantisches Verständnis und die Fähigkeit, aus der Stimme heraus Aktionen auszulösen, in einer einzigen Lösung.

Cet article publirédactionnel est publié dans le cadre d'une collaboration commerciale