În scurt : Misiunea internațională "ICHIBAN" a reușit să facă doi roboți să comunice și să coopereze la bordul ISS, deschizând perspective pentru interacțiunile robotice în mediul orbital, un progres major pentru misiunile lunare și marțiene viitoare.

Agenția spațială germană (DLR) și Agenția japoneză pentru explorare aerospațială (JAXA) anunță că misiunea de cooperare internațională "ICHIBAN" a fost încununată de succes. Pentru prima dată, doi roboți de asistență pentru astronauți din programe naționale distincte au comunicat și cooperat în orbită la bordul ISS.

Unul dintre obiectivele misiunii ICHIBAN (primul în japoneză), care s-a încheiat pe 29 iulie trecut, a fost testarea coordonării mai multor roboți distincți care operează simultan și în timp real la bordul ISS.

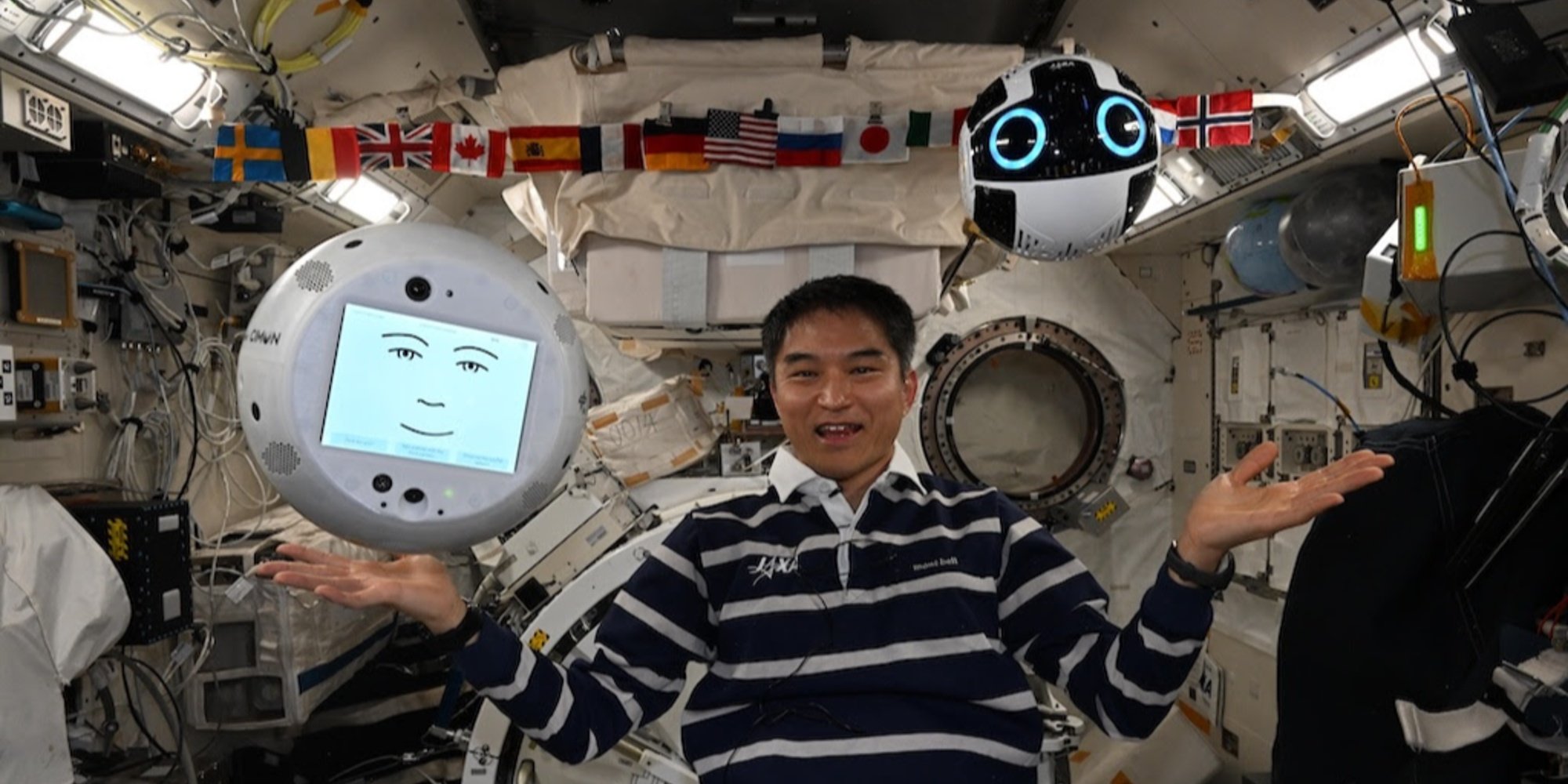

Cei doi roboți implicați în experiment sunt CIMON, dezvoltat de DLR, Airbus și IBM, precum și Int-Ball2, conceput de JAXA, instalați respectiv în modulele de experimentare european Columbus și japonez Kibo.

Dezvoltat pentru prima dată în 2018, CIMON (Crew Interactive Mobile Companion) este un robot sferic, de dimensiunea unei mingi, imprimat 3D, propulsat de tehnologiile vocale și cognitive ale watsonx, platforma AI de la IBM. În timpul misiunii ICHIBAN, CIMON a fost operat de BIOTESC, centrul elvețian al ESA specializat în operațiunile științifice la bordul stației internaționale.

De cealaltă parte, Int-Ball2 este o evoluție a primului drone cameră de la JAXA. Integrat din 2023 în modulul japonez, permite celulei de control la sol din Tsukuba (Japonia) să filmeze la distanță activitățile astronauților, optimizând astfel documentarea științifică fără a mobiliza echipajul stației spațiale internaționale. Până acum, nicio capacitate de interacțiune cu alți roboți nu fusese prevăzută.

Demonstrația a fost condusă de Takuya Onishi, astronaut al JAXA la bordul ISS. Din modulul Columbus, el a transmis comenzi vocale către CIMON, care a servit ca interfață lingvistică inteligentă. Instrucțiunea a fost procesată de platforma watsonx de la IBM, înainte de a fi tradusă în comenzi operaționale adresate către Int-Ball2.

Acesta din urmă a navigat atunci în modulul Kibo pentru a căuta și localiza diverse obiecte ascunse: un Cub Rubik, un ciocan, mai multe șurubelnițe și o versiune veche a Int-Ball scoasă din funcțiune. A transmis apoi imaginile în direct pe ecranul CIMON, permițându-i lui Onishi să verifice vizual poziția lor de la distanță.

Credit: JAXA/DLR;

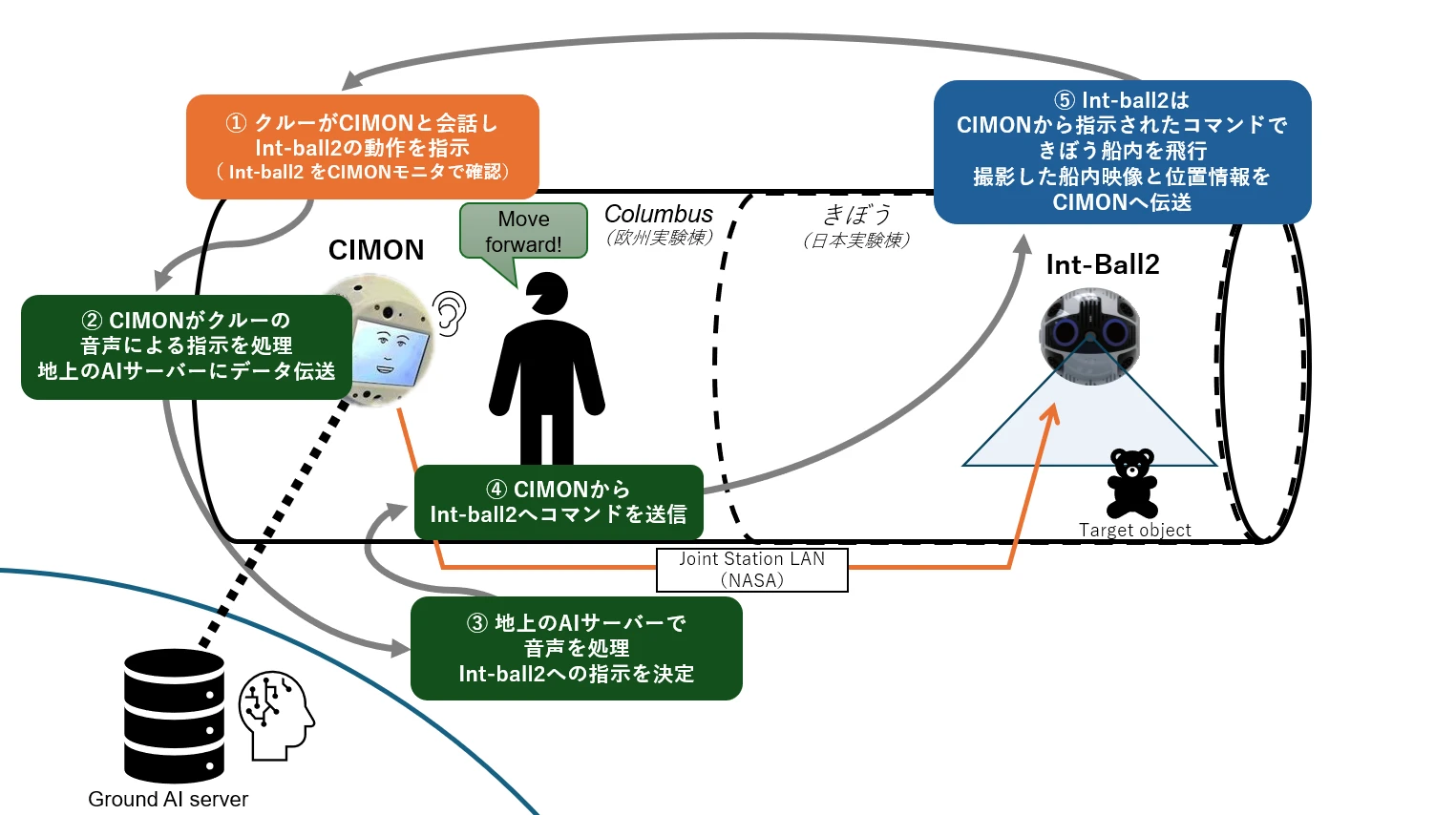

Ilustrație Tablou de colaborare al misiunii ICHIBAN

Ilustrație Tablou de colaborare al misiunii ICHIBAN

Astronautul dă o instrucțiune vocală către CIMON pentru ca Int-Ball2 să efectueze o sarcină (etapa ①). CIMON transmite această comandă vocală către un server AI situat la sol, care analizează intenția comenzii (etapele ② și ③). Întoarcerea instrucțiunii către ISS: odată procesată, comanda este trimisă înapoi de la sol prin LAN-ul stației (Joint Station LAN/NASA) către CIMON, care o transmite către Int-Ball2 (etapa ④). Acesta din urmă acționează în consecință în modulul japonez "Kibo", efectuează sarcina sa (de exemplu, localizarea unui obiect), apoi trimite imaginile și datele de poziție către CIMON.

Inovația rezidă în faptul că, până acum, imaginile capturate de Int-Ball2 nu puteau fi transmise decât către centrul de control din Tsukuba. Posibilitatea de a le trimite în timp real către un alt robot la bord deschide un nou câmp pentru interacțiunile robotice distribuite în mediu orbital.

Un prim pas care capătă toată importanța în perspectiva viitoarelor misiuni lunare și marțiene.