Em resumo : Mistral AI lança Magistral, um modelo avançado de raciocínio em duas versões para diferentes usos, competindo com a DeepSeek.

Índice

No final de janeiro passado, enquanto todos estavam com os olhos voltados para a DeepSeek e seu modelo R1, a Mistral AI introduziu discretamente o Small 3, anunciando a chegada iminente de modelos Mistral com capacidades de raciocínio aprimoradas. Agora isso se concretizou: após o Small 3.1 apresentado em março passado, o unicórnio acaba de revelar o Magistral, seu primeiro modelo de raciocínio em larga escala, disponível em duas variantes, uma de código aberto 'Magistral Small', e a outra orientada para empresas, 'Magistral Medium'.

Com o Magistral, a Mistral AI dá um novo passo. Não na corrida pelo tamanho, mas na busca por uma IA mais explicável, mais alinhada ao raciocínio humano, e sobretudo, mais adaptada às realidades operacionais das empresas. O novo modelo se baseia nos avanços do Small 3.1, suporta muitos idiomas, incluindo inglês, francês, espanhol, alemão, italiano, árabe, russo e chinês simplificado. Ele implementa uma cadeia de raciocínio explícita, passo a passo, que pode ser seguida, questionada e auditada no idioma do usuário.

Magistral Small

A Mistral AI lançou o Magistral Small sob licença Apache 2.0, permitindo assim que a comunidade o utilize, refine e implemente para diversos casos de uso. Ele pode ser baixado em https://huggingface.co/mistralai/Magistral-Small-2506 .

Esta versão foi otimizada através de um ajuste fino supervisionado (SFT) baseado nos traços de raciocínio gerados pelo Magistral Medium durante suas interações e então reforçado por aprendizado (RLHF) para aprimorar a qualidade e a coerência do raciocínio.

Contando, assim como os modelos Small 3, com 24 bilhões de parâmetros, o Magistral Small, uma vez quantificado, pode ser implementado em configurações de hardware acessíveis, como um PC operando com uma única GPU RTX 4090 ou um Mac com 32 GB de RAM, permitindo que os desenvolvedores mantenham o controle sobre seus dados sensíveis sem depender de uma infraestrutura em nuvem centralizada.

Magistral Medium

Esta variante é a versão empresarial do Magistral. Mais poderoso, está disponível na plataforma Le Chat da Mistral e via API da empresa. Atualmente implantado na Amazon SageMaker, em breve estará também no IBM WatsonX, Azure AI e Google Cloud Marketplace.

De acordo com o unicórnio, o Flash Answers no Chat permite reduzir drasticamente a latência das respostas. Segundo eles, o Magistral Medium atinge uma velocidade de processamento até 10 vezes superior à de muitos concorrentes.

O desempenho do Magistral

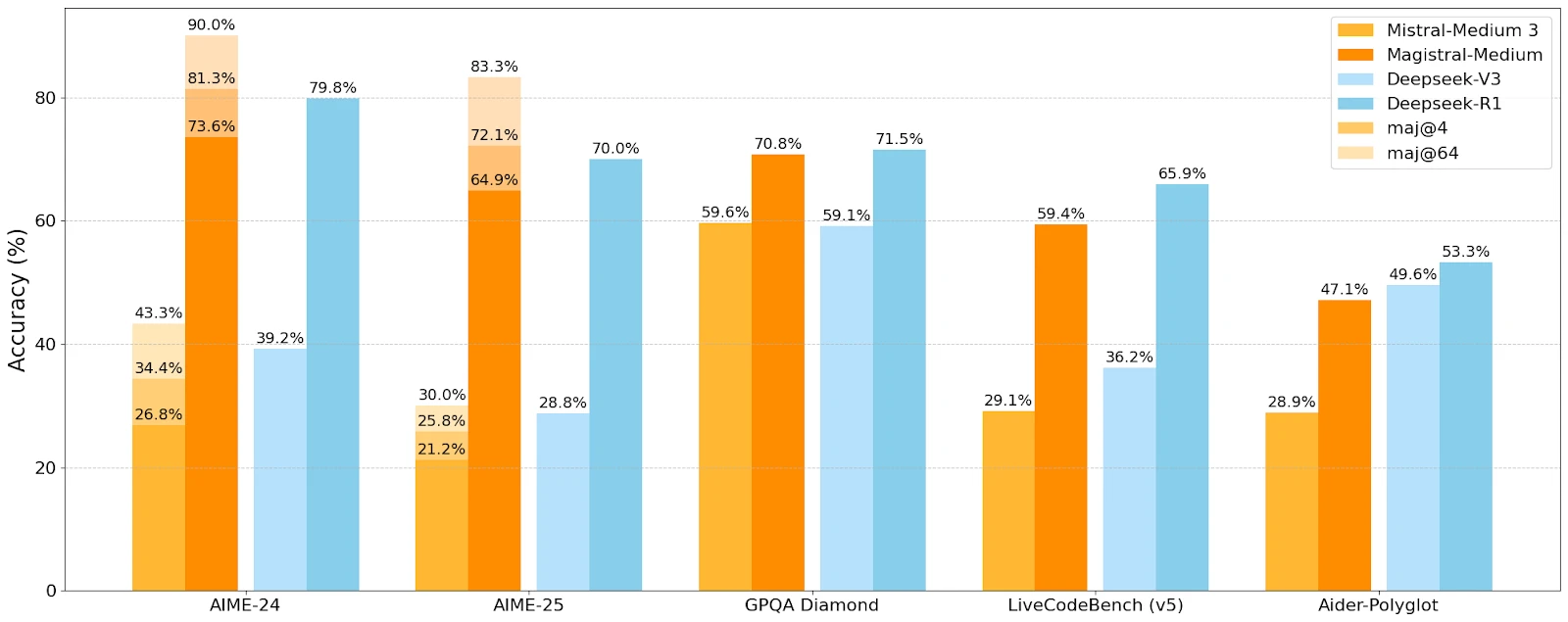

A Mistral AI comparou o desempenho do Magistral com o do Mistral Medium e de modelos concorrentes da DeepSeek em diferentes benchmarks de raciocínio e compreensão.

O Magistral-Medium supera o Mistral-Medium 3 em todos os benchmarks, provando a eficácia do raciocínio aprimorado. Nos benchmarks AIME 2024, o Medium atinge uma pontuação de 73,6% com 90% de voto majoritário, contra 70,7% e 83,3% para o Small. Resultados competitivos, mesmo que a DeepSeek mantenha uma vantagem em alguns benchmarks.

Casos de uso bem definidos

A Mistral AI visa casos de uso onde o raciocínio passo-a-passo é determinante:

- Tomada de decisão estratégica

- Pesquisa jurídica

- Previsão financeira

- Desenvolvimento de software em várias etapas

- Redação narrativa e geração de conteúdo

- Análise regulatória e conformidade

Essa diversidade sugere uma intenção de penetrar tanto nos setores regulamentados quanto nas profissões técnicas de alta densidade cognitiva, sem sacrificar a abertura para usos mais 'criativos'.