W skrócie : Misja międzynarodowa "ICHIBAN" prowadzona przez niemiecką agencję kosmiczną (DLR) i japońską agencję eksploracji aerokosmicznej (JAXA) z sukcesem umożliwiła komunikację i współpracę dwóch robotów wspomagających astronautów na pokładzie ISS. Ten sukces otwiera perspektywy dla interakcji robotycznych w środowisku orbitalnym, co jest ważnym krokiem w kontekście przyszłych misji księżycowych i marsjańskich.

Niemiecka agencja kosmiczna (DLR) oraz Japońska Agencja Eksploracji Aerokosmicznej (JAXA) ogłosiły, że międzynarodowa misja współpracy "ICHIBAN" zakończyła się sukcesem. Po raz pierwszy dwa roboty wspomagające astronautów, pochodzące z odrębnych programów narodowych, komunikowały się i współpracowały na orbicie na pokładzie ISS.

Jednym z celów misji ICHIBAN (pierwsza po japońsku), która zakończyła się 29 lipca, było przetestowanie koordynacji kilku odrębnych robotów działających jednocześnie i w czasie rzeczywistym na pokładzie ISS.

Dwa roboty zaangażowane w eksperyment to CIMON, rozwinięty przez DLR, Airbus i IBM oraz Int-Ball2, zaprojektowany przez JAXA, zainstalowane odpowiednio w europejskim module eksperymentalnym Columbus i japońskim Kibo.

Po raz pierwszy wdrożony w 2018 roku, CIMON (Crew Interactive Mobile Companion) to kulisty robot wielkości piłki, wydrukowany w 3D, napędzany technologiami głosowymi i kognitywnymi watsonx, platformy AI IBM. Podczas misji ICHIBAN, CIMON był obsługiwany przez BIOTESC, szwajcarskie centrum ESA specjalizujące się w operacjach naukowych na pokładzie międzynarodowej stacji.

Z kolei Int-Ball2 jest ewolucją pierwszego drona kamerowego JAXA. Zintegrowany od 2023 roku w module japońskim, pozwala zespołowi kontrolnemu na ziemi w Tsukuba (Japonia) filmować zdalnie działania astronautów, optymalizując tym samym dokumentację naukową bez angażowania załogi międzynarodowej stacji kosmicznej. Dotychczas nie przewidywano możliwości interakcji z innymi robotami.

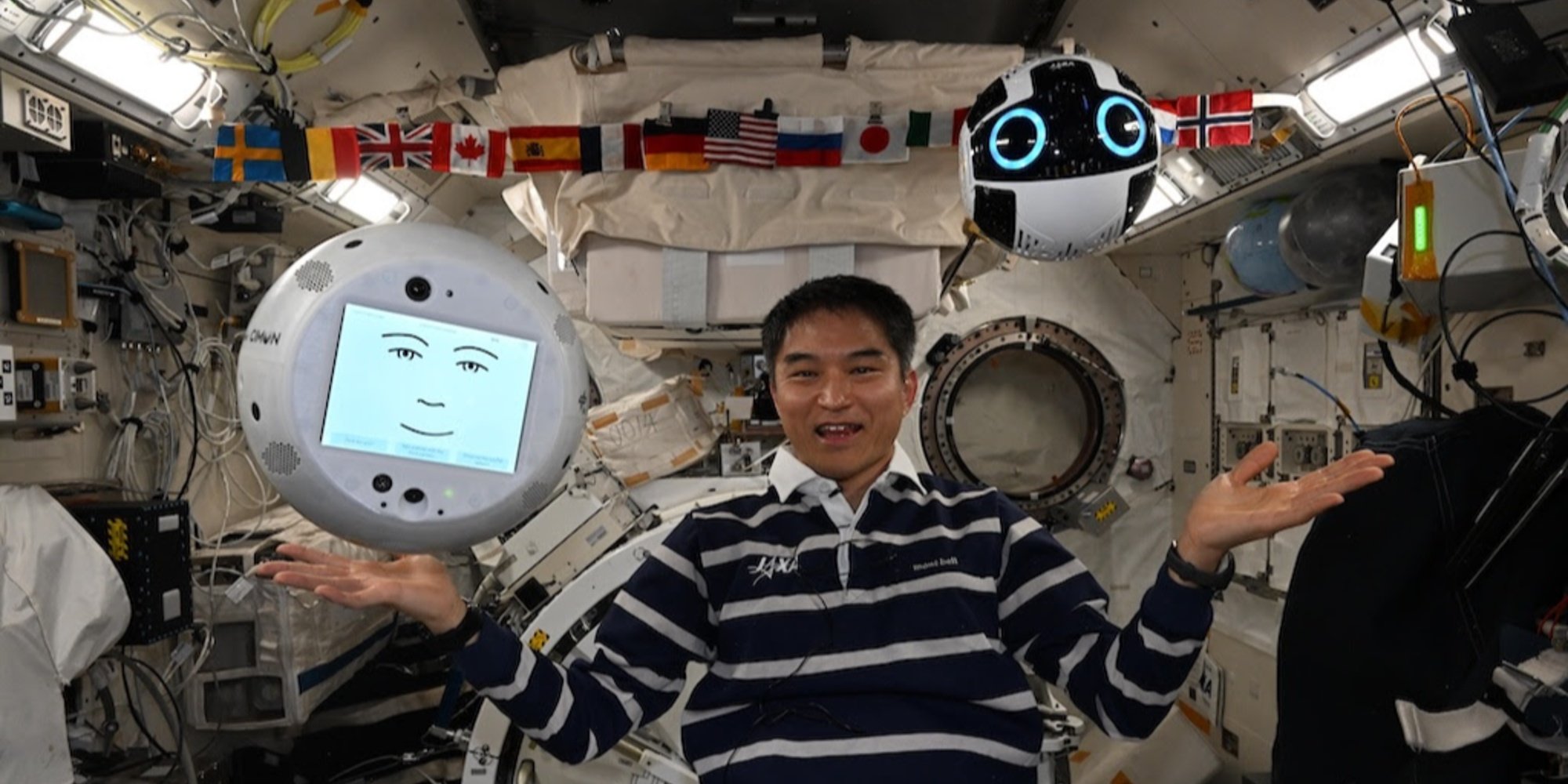

Demonstrację przeprowadził Takuya Onishi, astronauta JAXA na pokładzie ISS. Z modułu Columbus przesłał polecenia głosowe do CIMON, który służył jako inteligentny interfejs językowy. Instrukcja została przetworzona przez platformę watsonx IBM, zanim została przetłumaczona na operacyjne polecenia skierowane do Int-Ball2.

Ten ostatni następnie poruszał się w module Kibo, aby szukać i lokalizować różne ukryte obiekty: kostkę Rubika, młotek, kilka śrubokrętów i starą wersję Int-Ball wycofaną z eksploatacji. Następnie przesyłał obrazy na żywo na ekran CIMON, pozwalając Onishi na wizualne zweryfikowanie ich położenia na odległość.

Kredyt: JAXA/DLR;

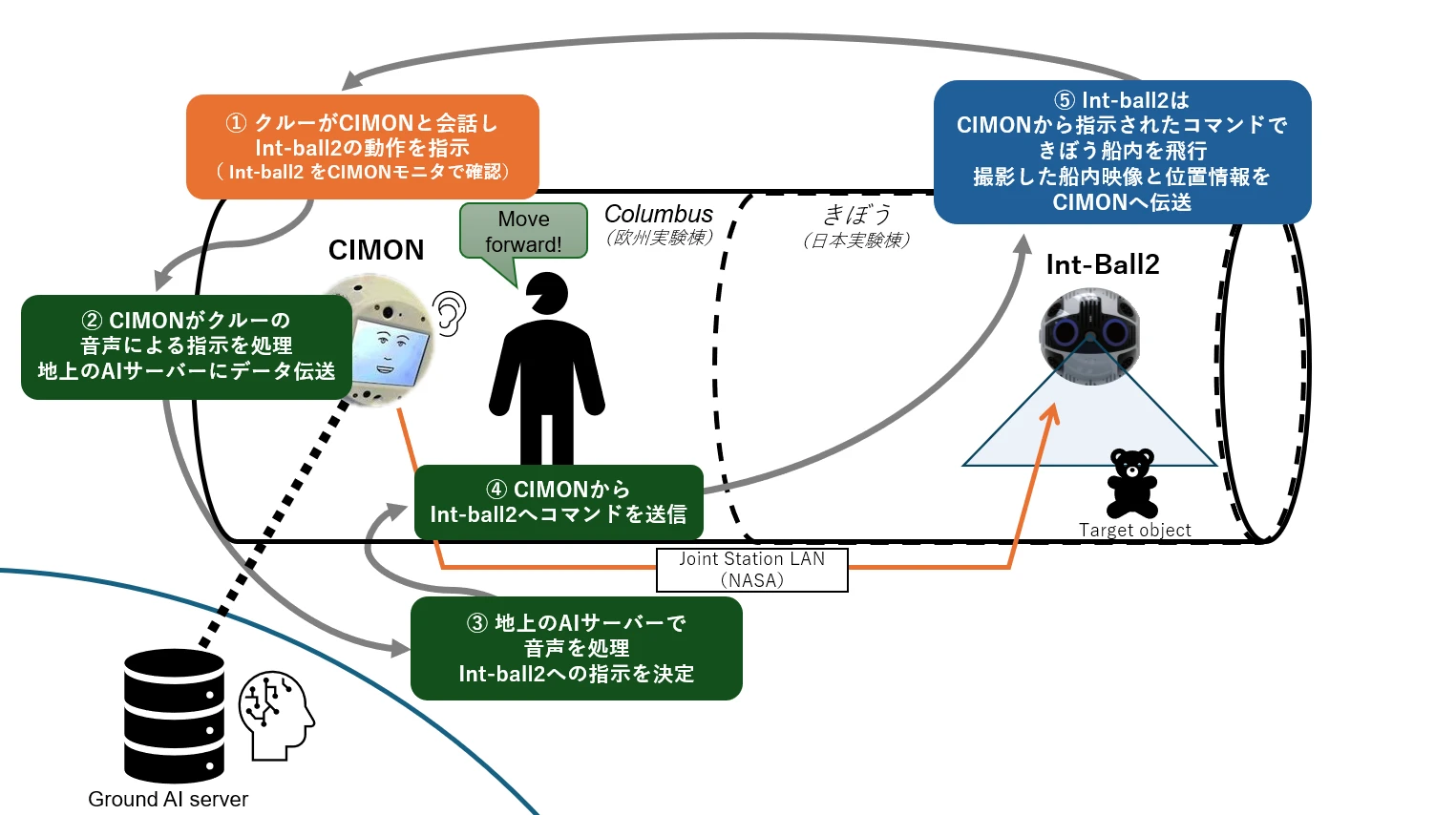

Ilustracja Tablica współpracy misji ICHIBAN

Ilustracja Tablica współpracy misji ICHIBAN

Astronauta wydaje polecenie głosowe do CIMON, aby Int-Ball2 wykonał zadanie (krok ①). CIMON przesyła to polecenie głosowe do serwera AI znajdującego się na ziemi, który analizuje intencję polecenia (kroki ② i ③). Powrót instrukcji na ISS: po przetworzeniu, polecenie jest wysyłane z ziemi przez LAN stacji (Joint Station LAN/NASA) do CIMON, który przesyła je do Int-Ball2 (krok ④). Ten ostatni działa w module japońskim "Kibo", wykonuje swoje zadanie (na przykład lokalizuje obiekt), a następnie przesyła obrazy i dane położenia do CIMON.

Innowacja polega na tym, że do tej pory obrazy uchwycone przez Int-Ball2 mogły być przesyłane tylko do centrum kontroli w Tsukuba. Możliwość ich wysyłania w czasie rzeczywistym do innego robota na pokładzie otwiera nową przestrzeń dla rozproszonych interakcji robotycznych w środowisku orbitalnym.

Pierwszy krok, który nabiera ogromnego znaczenia w kontekście przyszłych misji księżycowych i marsjańskich.