TLDR : Mistral AI presenta Magistral, un modelo de razonamiento avanzado que desafía a DeepSeek, optimizado para usos empresariales y disponible en versiones de código abierto y empresarial.

Índice

A finales de enero pasado, mientras todos tenían los ojos puestos en DeepSeek y su modelo R1, Mistral AI introdujo discretamente Small 3, anunciando la llegada próxima de modelos Mistral con capacidades de razonamiento mejoradas. Eso ya es un hecho: después de Small 3.1 presentado en marzo pasado, la unicornio acaba de revelar Magistral, su primer modelo de razonamiento a gran escala, disponible en dos variantes, una de código abierto "Magistral Small", y otra orientada a empresas, "Magistral Medium".

Con Magistral, Mistral AI da un nuevo paso. No en la carrera por el tamaño, sino en la búsqueda de una IA más explicable, más anclada en el razonamiento humano y, sobre todo, más adaptada a las realidades operativas de las empresas. El nuevo modelo se basa en los avances de Small 3.1, admite numerosos idiomas, incluidos inglés, francés, español, alemán, italiano, árabe, ruso y chino simplificado. Implementa una cadena de razonamiento explícita, paso a paso, que puede ser seguida, interrogada y auditada en el idioma del usuario.

Magistral Small

Mistral AI ha publicado Magistral Small bajo la licencia Apache 2.0, permitiendo así a la comunidad usarlo, afinarlo y desplegarlo para diversos casos de uso. Está disponible para descargar en https://huggingface.co/mistralai/Magistral-Small-2506 .

Esta versión ha sido optimizada gracias a un fine-tuning supervisado (SFT) basado en las trazas de razonamiento generadas por Magistral Medium durante sus interacciones y luego reforzada por aprendizaje (RLHF) para mejorar la calidad y coherencia del razonamiento.

Contando, al igual que los modelos Small 3, con 24 mil millones de parámetros, Magistral Small, una vez cuantificado, puede ser desplegado en configuraciones de hardware accesibles, como una PC funcionando con una sola GPU RTX 4090 o un Mac con 32 GB de RAM, lo que permite a los desarrolladores mantener el control sobre sus datos sensibles sin depender de una infraestructura de nube centralizada.

Magistral Medium

Esta variante es la versión empresarial de Magistral. Más potente, está disponible en la plataforma Le Chat de Mistral y a través de la API de la empresa. Actualmente desplegado en Amazon SageMaker, próximamente lo estará en IBM WatsonX, Azure AI y Google Cloud Marketplace.

Según la unicornio, Flash Answers en el Chat permite reducir drásticamente la latencia de las respuestas. Según ellos, Magistral Medium alcanza una velocidad de procesamiento hasta 10 veces superior a la de muchos competidores.

Las prestaciones de Magistral

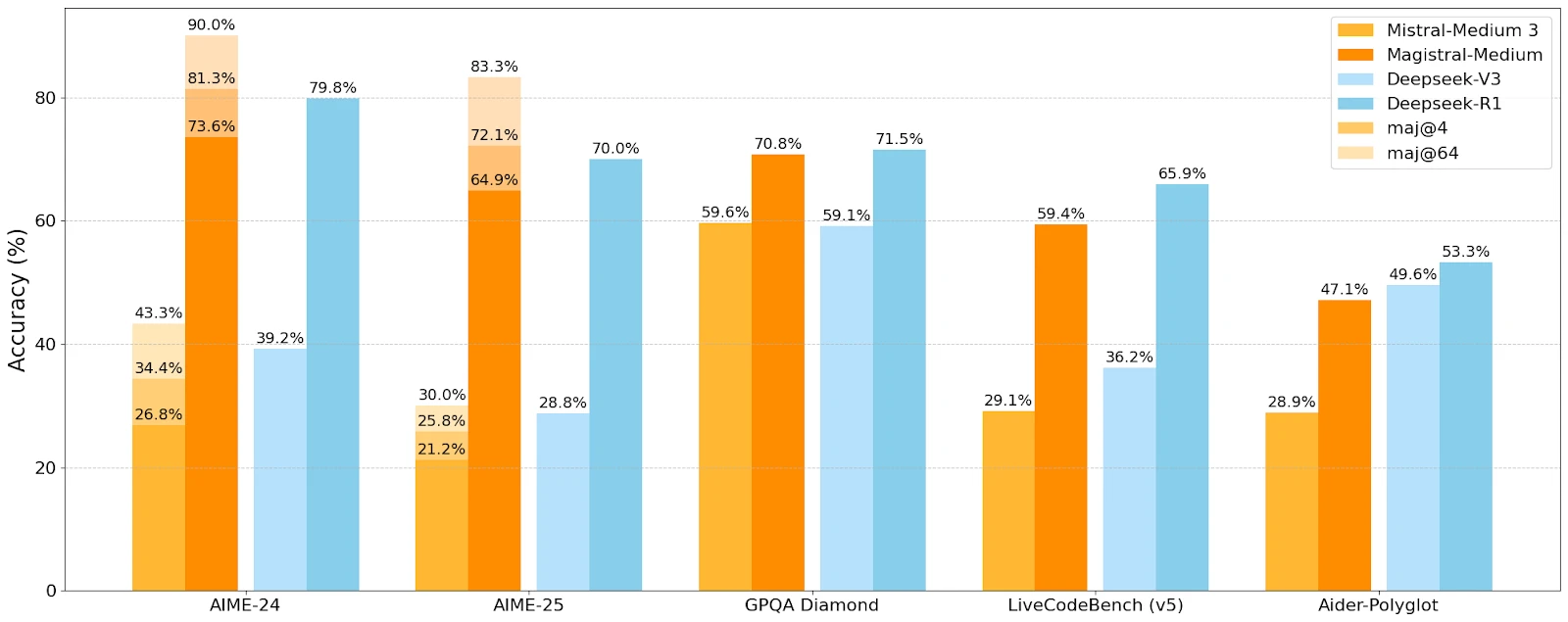

Mistral AI ha comparado las prestaciones de Magistral con las de Mistral Medium y los modelos competidores de DeepSeek en diferentes benchmarks de razonamiento y comprensión.

Magistral-Medium supera a Mistral-Medium 3 en todos los benchmarks, demostrando la eficacia del razonamiento mejorado. En los benchmarks AIME 2024, Medium alcanza una puntuación del 73,6% con un 90% de voto mayoritario, frente al 70,7% y 83,3% para Small. Resultados competitivos, aunque DeepSeek mantiene una ventaja en algunos benchmarks.

Casos de uso bien definidos

Mistral AI apunta a casos de uso donde el razonamiento paso a paso es determinante:

- Toma de decisiones estratégicas

- Investigación jurídica

- Previsión financiera

- Desarrollo de software en múltiples etapas

- Redacción narrativa y generación de contenidos

- Análisis regulatorio y cumplimiento

Esta diversidad sugiere una intención de penetrar tanto en sectores regulados como en profesiones técnicas con alta densidad cognitiva, sin sacrificar la apertura hacia usos más "creativos".