من تشخيص الأمراض إلى اكتشاف العلاجات الجديدة، يعد الذكاء الاصطناعي بتحسين دقة وفعالية الرعاية. في حين أن ثلثهم قد استشاروا بالفعل ذكاء اصطناعي توليدي للحصول على نصائح طبية، هل الفرنسيون مستعدون للثقة به واتباع توصياته دون التحقق من طبيبهم؟

في مارس الماضي، قامت FLASHS باستطلاع رأي لحساب MedTech Galeon، شمل 2003 فرنسي وفرنسية يبلغون من العمر 18 عامًا أو أكثر، يمثلون السكان الفرنسيين، بهدف فهم تصورهم للذكاء الاصطناعي في مجال الصحة.

اعتماد تدريجي مصحوب بخطوط انقسام

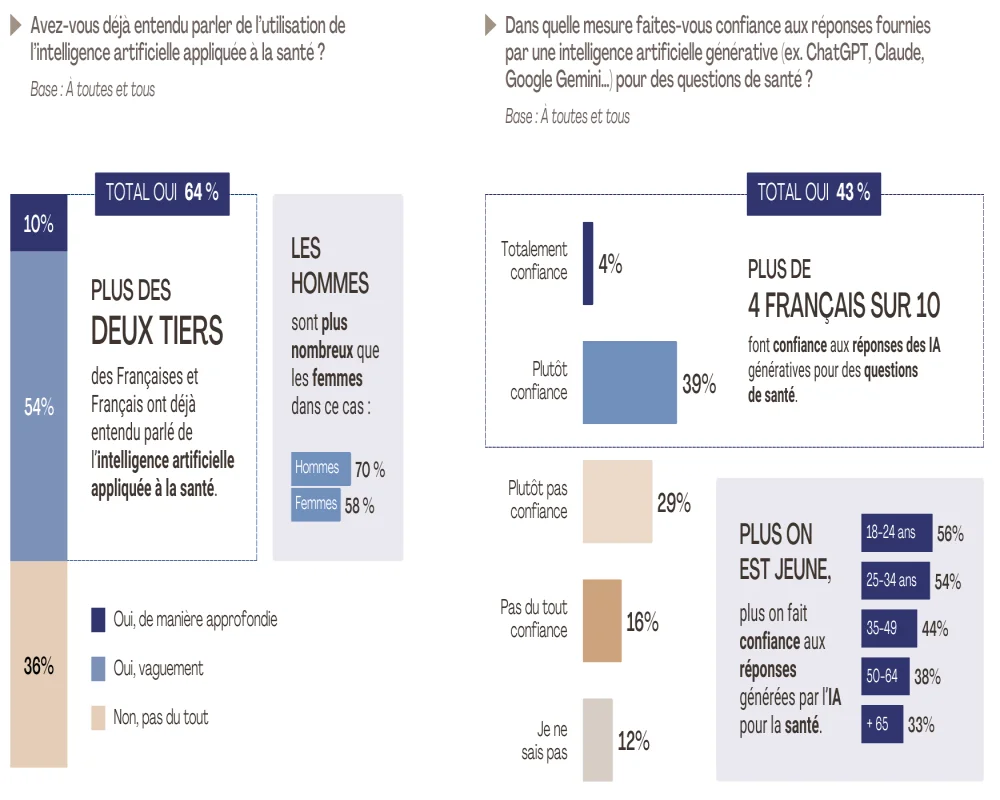

يكشف الاستطلاع عن تزايد الفهم لكن بشكل غير متساوٍ لهذه التقنيات. إذا أعلن 64٪ من المستجيبين (70٪ من الرجال مقابل 58٪ من النساء) أنهم سمعوا عن الذكاء الاصطناعي الطبي، فإن 10٪ فقط يعتبرون أنهم يمتلكون معرفة عميقة به. الانقسام واضح بين الجنسين وكذلك بين الأجيال. الشباب من 18 إلى 24 عامًا يظهرون ميلاً أكبر لاستخدام الذكاء الاصطناعي (68٪)، في حين أن 10٪ فقط من الذين تزيد أعمارهم عن 65 عامًا قد فعلوا ذلك.

هذه الفجوات لا تعكس فقط اختلافات في التعرض للابتكار. بل قد تعكس أيضًا مواقف متباينة تجاه المخاطر، الاستقلالية في اتخاذ القرارات الطبية أو الثقة في الأنظمة الآلية.

تقنية موثوقة... لكنها تبحث عن شرعية

مع ذلك، تظل الثقة في هذه الأدوات متباينة: 43٪ من الفرنسيين يمنحون بعض المصداقية للإجابات التي تقدمها الذكاء الاصطناعي مثل ChatGPT أو Google Gemini في مجال الصحة، مقابل 45٪ الذين يظلون متشككين. تظل الثقة الكاملة هامشية (4٪)، في حين أن عدم الثقة المطلق أكثر وضوحًا (16٪).

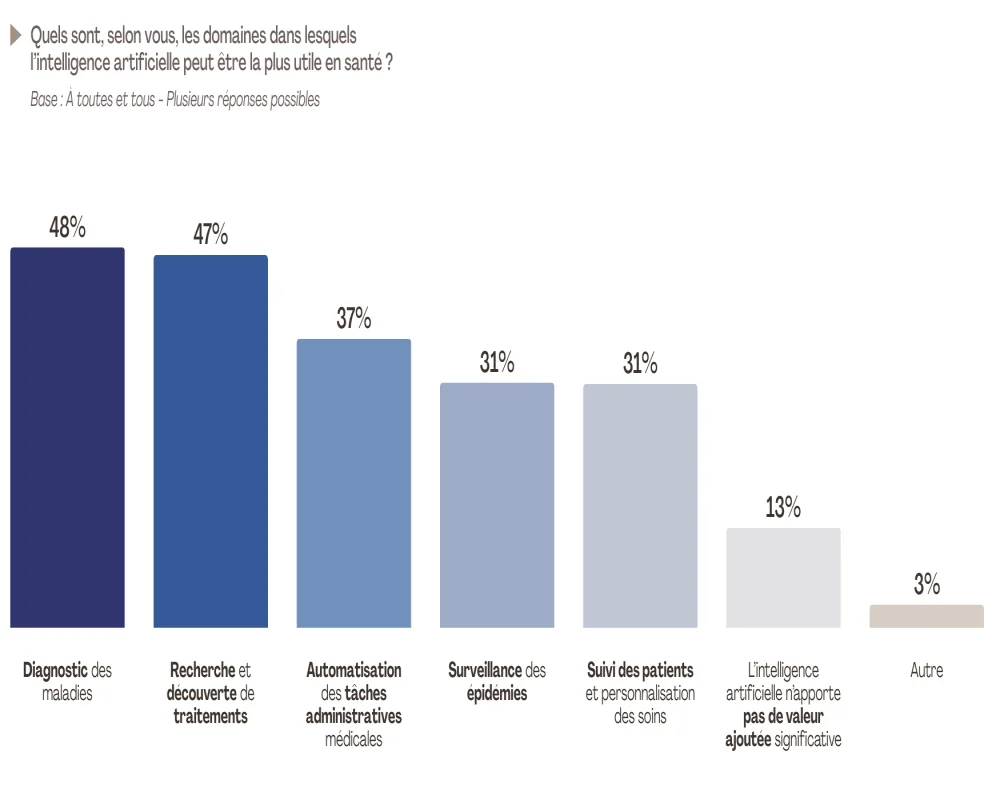

لكن الإمكانيات المدركة حقيقية: يأتي التشخيص (48٪) والبحث العلاجي (47٪) في مقدمة الاستخدامات التي تعتبر الأكثر أهمية. تثير الوظائف الأكثر طرفية - مثل الأتمتة الإدارية أو المراقبة الوبائية - اهتمامًا أقل ولكنه ملموس. فقط 13٪ يعتبرون أن الذكاء الاصطناعي لا يضيف أي قيمة إلى قطاع الصحة.

إدارة المخاطر: توازن يجب تحقيقه

من بين الذين استشاروا الذكاء الاصطناعي في مواضيع تتعلق بالصحة، يقول ستة من كل عشرة أنهم اتبعوا التوصيات التي حصلوا عليها. جزء لا يستهان به (17٪) يطبقون نصائح الذكاء الاصطناعي دون استشارة طبية، مما يطرح تساؤلات حول الحاجة إلى تنظيم أكثر صرامة في قطاع تاريخيًا تحكمه مبادئ المسؤولية، الحذر والتتبع.

جودة البيانات المدخلة، التي تكون غالبًا غير متجانسة وأحيانًا منحازة، تحدد مباشرة جودة التوصيات التي تنتجها الذكاء الاصطناعي. بالإضافة إلى ذلك، فإن غموض الخوارزميات المستخدمة، خصوصًا في الأنظمة المعروفة بـ"الصندوق الأسود"، يحد من فهم القرارات المولدة، حتى من قبل المهنيين الصحيين أنفسهم.

بينما يُنظر إلى الخطأ البشري عمومًا بنظرة نسبية بناءً على تعقيد الحالة، يُعتبر الخطأ الخوارزمي كخلل في النظام، وبالتالي أقل تسامحًا بكثير: فقط 9٪ من الفرنسيين يقبلونه، مقابل 20٪ للخطأ البشري.

هل يمكن للذكاء الاصطناعي تجاوز الخبرة البشرية؟

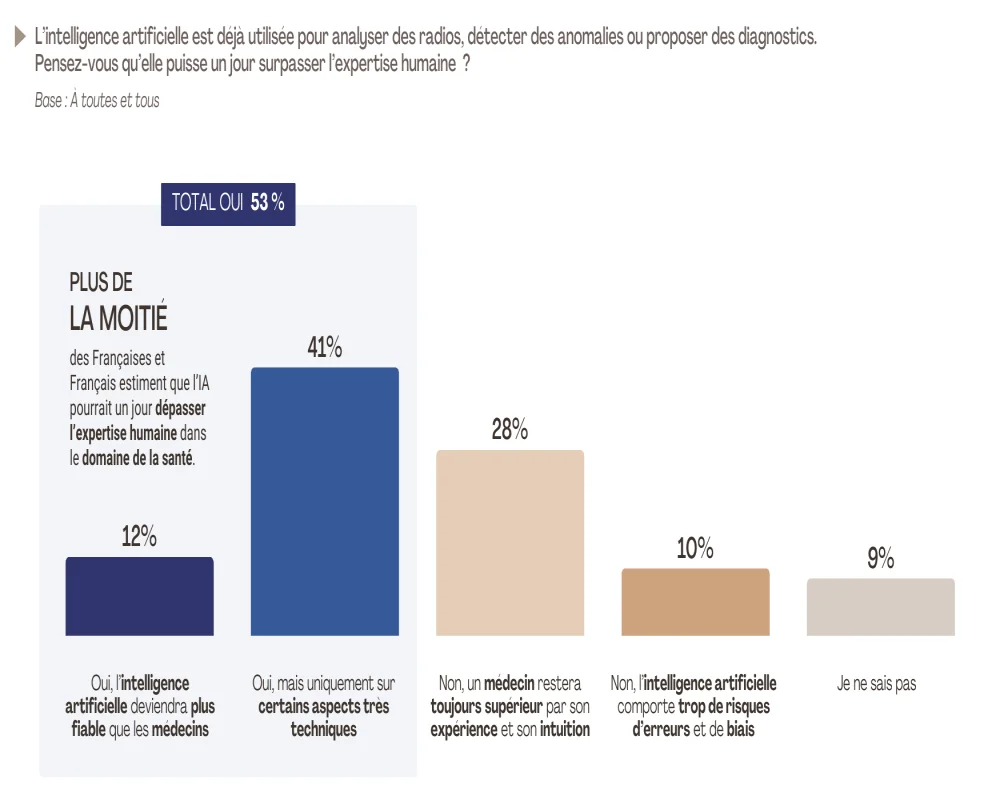

عند سؤال الفرنسيين عن قدرة الذكاء الاصطناعي على تجاوز المهارات البشرية، تتبنى أغلبية نسبية موقفًا متوازنًا. فقط 12٪ يعتقدون أنه يمكن أن يصبح أكثر موثوقية من الأطباء في كل مسار الرعاية. لكن أكثر من واحد من كل اثنين (53٪) يعترفون أنه يمكن أن يتفوق على المهنيين في بعض المجالات المستهدفة، وخاصة التقنية، مثل تحليل الصور الطبية أو الكشف المبكر عن الإشارات الضعيفة.

أداة وليست بديلًا: فرضية الشفافية ضرورية

اللا إنسانية في الرعاية هي القلق الرئيسي للفرنسيين (34٪)، يليها خطر الخطأ (28٪) ونقص السيطرة البشرية (24٪). إذا كان 30٪ من المستجيبين مستعدين لقبول عملية جراحية تُجرى بالكامل بواسطة الذكاء الاصطناعي، فإن 40٪ يصرون على ضرورة وجود طبيب.

يفضل الفرنسيون نهجًا هجينًا: ما يقرب من نصفهم (49٪) يفضلون أن يعتمد طبيبهم على الذكاء الاصطناعي لتحسين التشخيص أو التوصية بالعلاج. تعلم رئيسي من الدراسة هو الطلب على الشفافية. بالنسبة لـ 4 من كل 5 فرنسيين، من الضروري أن يتم إبلاغهم باستخدام الذكاء الاصطناعي في رعايتهم، ويود ما يقرب من نصفهم معرفة التفاصيل الدقيقة لذلك. هذا المطلب يخص جميع الأجيال ويلاحظ بغض النظر عن الجنس.

لذلك سيكون التنظيم الأخلاقي ووضوح الممارسات عوامل حاسمة لتعزيز قبول الذكاء الاصطناعي في السنوات القادمة في مجال الصحة.